毕业设计:基于计算机视觉的足球比赛中运动员和足球检测与跟踪 目标检测

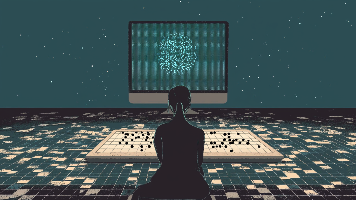

毕业设计:毕业设计:基于计算机视觉的足球比赛中运动员和足球检测与跟踪使用YOLOv5和Deep SORT进行运动员和足球检测与跟踪的整体流程。首先,通过YOLOv5对视频帧进行目标检测,实现对运动员和足球的快速识别及边界框生成。然后,将检测结果传递给Deep SORT,结合运动信息和预训练的CNN提取目标外观特征,以提高跟踪的准确性。最后,在每一帧中,Deep SORT根据目标的特征和运动轨迹进行

目录

前言

📅大四是整个大学期间最忙碌的时光,一边要忙着备考或实习为毕业后面临的就业升学做准备,一边要为毕业设计耗费大量精力。近几年各个学校要求的毕设项目越来越难,有不少课题是研究生级别难度的,对本科同学来说是充满挑战。为帮助大家顺利通过和节省时间与精力投入到更重要的就业和考试中去,学长分享优质的选题经验和毕设项目与技术思路。

🚀对毕设有任何疑问都可以问学长哦!

选题指导:

大家好,这里是海浪学长毕设专题,本次分享的课题是

🎯基于计算机视觉的足球比赛中运动员检测与跟踪

课题背景和意义

足球比赛是全球范围内受欢迎的体育活动,比赛过程中的动态场景复杂且快速,运动员、足球和其他相关对象的检测与跟踪对于赛事分析、战术研究和观众体验提升具有重要意义。传统的视频分析方法通常依赖于手工特征提取和简单的跟踪算法,难以满足实时性和准确性要求。近年来,深度学习技术的快速发展为目标检测与跟踪提供了新的解决方案。通过充分利用深度学习模型在图像识别和视频分析中的强大能力,研究者能够实现对足球比赛视频中目标的高效检测与精确跟踪。

实现技术思路

一、算法理论基础

1.1 目标检测算法

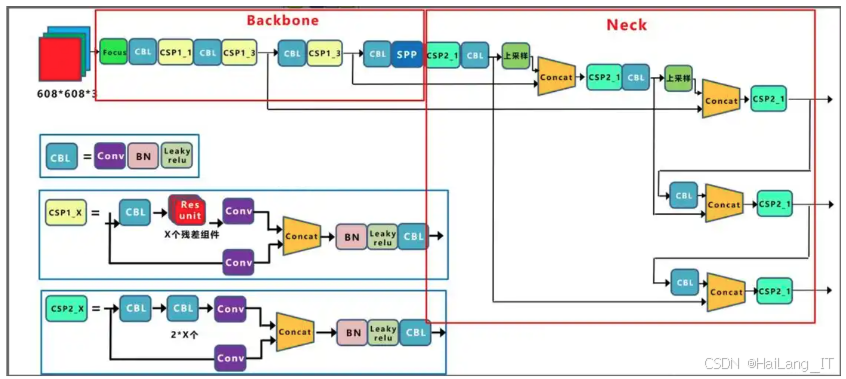

YOLOv5是一种先进的目标检测算法,广泛应用于实时目标检测任务。它的核心思想是将目标检测视为一个回归问题,通过单次前向推理直接从图像中预测目标的边界框和类别概率。YOLOv5在速度和精度之间找到了良好的平衡,具备较高的实时性,适合动态场景下的运动员和足球检测。其网络架构采用了多层卷积神经网络,并在不同的特征层上进行检测,以捕捉多尺度目标信息,从而能够有效识别不同大小的目标。

在使用YOLOv5进行目标检测之前,对视频帧进行预处理是至关重要的。首先,从视频流中提取每一帧,并进行尺寸调整,以适应YOLOv5的输入要求。通常,将图像缩放到640x640或其他指定尺寸,以保持宽高比。其次,进行归一化处理,将像素值转换为0到1之间的浮点数。最后,将处理后的图像转换为张量格式,以便输入到YOLOv5模型中进行推理。通过这些预处理步骤,确保输入数据的一致性,从而提高检测的准确性和效率。

在完成数据预处理后,将图像输入YOLOv5模型进行目标检测。模型会通过其特征提取网络处理输入图像,生成多个边界框,每个边界框都包含目标的位置坐标、类别置信度和类别概率。YOLOv5使用非极大值抑制(NMS)算法来过滤冗余的边界框,从而保留最优的检测结果。最终,识别出的运动员和足球的边界框将以不同颜色进行标记,并可视化在原始视频帧上。这一过程不仅提升了目标检测的可视性,也为后续的运动员和足球跟踪提供了可靠的位置信息,进而实现精准的运动分析和战术研究。

1.3目标跟踪算法

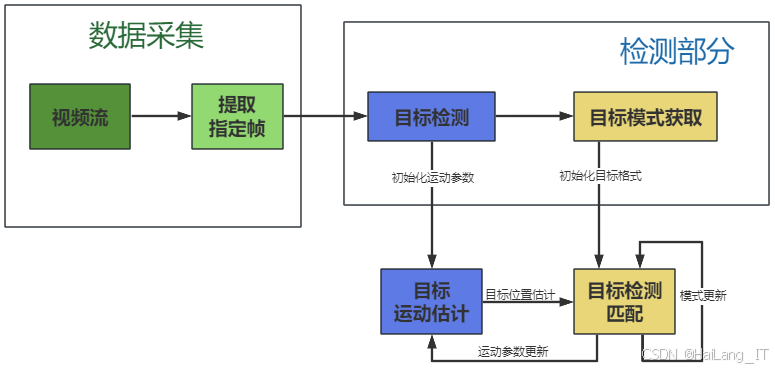

Deep SORT是一个基于目标检测的实时跟踪框架,旨在解决目标在动态环境中的身份保持问题。该算法结合了运动信息和深度学习提取的外观特征,从而提高跟踪的准确性和鲁棒性。通过使用卡尔曼滤波,Deep SORT能够预测目标在下一帧图像中的位置,并根据运动模型对目标状态进行更新。这种模型不仅能处理线性运动,还能适应非线性轨迹,从而在复杂场景中提高跟踪的效果。

在Deep SORT中,目标的外观特征是通过深度学习模型提取的,通常使用像MobileNet等预训练的CNN。这些外观特征能够有效描述目标的视觉属性,包括颜色、形状和纹理等信息。Deep SORT利用这些特征与目标的运动信息相结合,形成一个强大的身份匹配机制。当检测到运动员和足球后,Deep SORT会保持对每个目标的独特身份,通过计算外观特征之间的相似性来实现目标的持续跟踪。这种结合策略大大增强了系统在遮挡和外观变化情况下的鲁棒性。

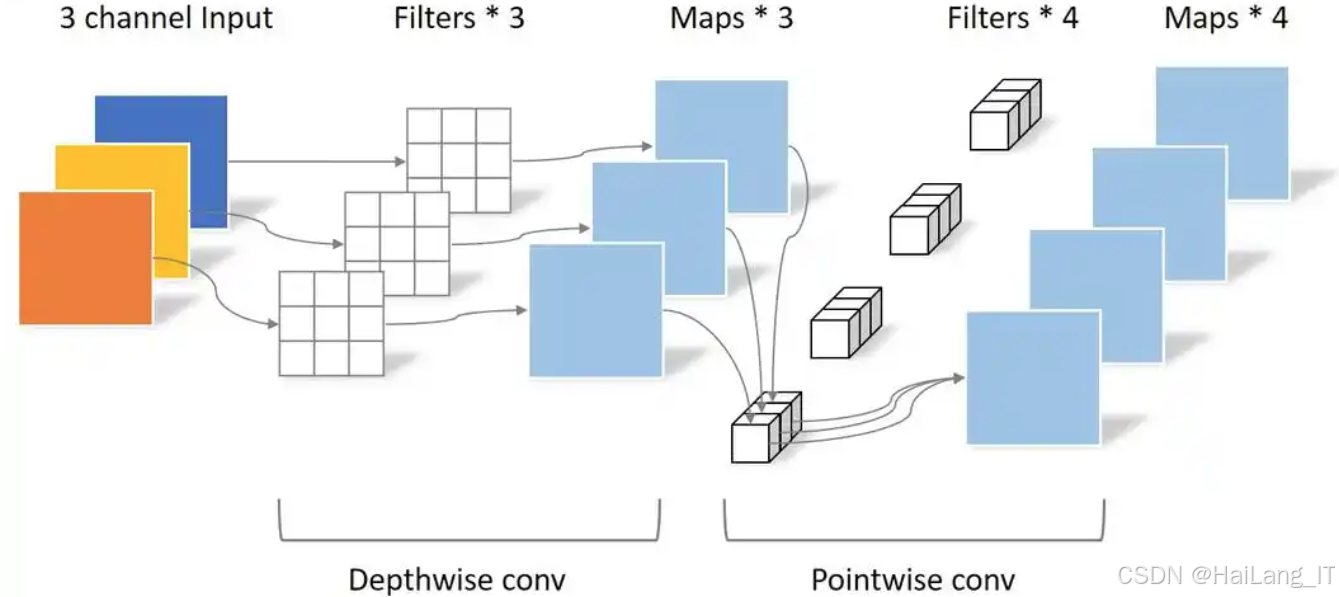

1.2 卷积神经网络

MobileNet是一种轻量级的卷积神经网络(CNN),专为移动和边缘设备的应用而设计。其核心创新在于采用了深度可分离卷积(Depthwise Separable Convolution),将标准卷积操作分解为两个阶段:深度卷积和逐点卷积。这种结构显著减少了模型的参数数量和计算复杂度,使得MobileNet在资源受限的环境中(如移动设备、实时监控系统等)仍能保持良好的检测性能。MobileNet在特征提取过程中能够有效捕捉运动员和足球的外观特征,包括颜色、形状和纹理等。这些特征对于后续的目标跟踪任务至关重要,能够提供精准的外观信息,从而使得跟踪算法更具鲁棒性和准确性。

在Deep SORT中,MobileNet作为特征提取网络,起到了关键作用。Deep SORT结合了运动信息与外观特征,能够在复杂环境中有效跟踪目标。通过使用MobileNet提取运动员和足球的高维特征,Deep SORT能够建立每个目标的独特身份。在每一帧中,Deep SORT利用这些外观特征进行目标匹配和身份保持,确保即使在遮挡、快速移动或外观变化的情况下,目标的跟踪依然稳定可靠。此外,MobileNet的轻量化设计使得整个系统在实时性方面表现出色,确保运动员和足球的连续跟踪不会受到延迟影响。这种特征提取与跟踪策略的结合,为足球比赛中的运动分析、战术研究和实时监控提供了强有力的支持。

二、 数据集

2.1 数据集

从各种来源收集高质量的足球比赛视频,包括体育赛事的官方网站、视频分享平台以及其他公开资源。所选视频应包含多样的比赛场景,以保证数据集的丰富性。在收集到视频后,使用视频处理工具将视频逐帧分解为静态图像。这一过程确保每帧图像能够代表比赛中的不同瞬间,从而为后续的标注和训练提供基础数据。

图像截取完成后,需对每张图像进行目标标注。使用标注工具(如LabelImg)进行手动标注,绘制运动员和足球的边界框,并为每个目标分配相应的类别标签(例如“运动员”和“足球”)。在标注时,应确保边界框尽可能精确,以提高后续模型训练的效果。标注过程中,建议记录运动员的编号或其他特征,以便在跟踪任务中使用。

2.2 数据划分

完成标注后,数据集需进行划分,以便于模型的训练、验证和测试。通常采用的划分比例为:70%用于训练集,15%用于验证集,15%用于测试集。在划分过程中,应确保各个子集均包含足够的运动员和足球样本,并且不同类别的样本分布均匀。这有助于提高模型的泛化能力和评估的有效性。

三、实验及结果分析

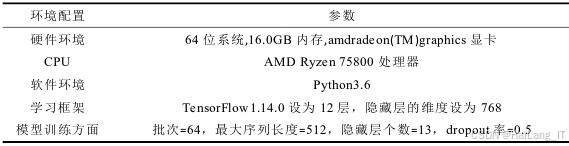

3.1 实验环境搭建

深度学习框架为构建、训练、优化和推理深度神经网络提供了必要的基础工具,使开发者能够更高效地进行相关工作。这些框架不仅简化了复杂的计算过程,还提供了丰富的功能和灵活的接口,帮助开发者快速实现各种深度学习算法。在众多深度学习框架中,PyTorch因其高度的扩展性和可移植性而受到广泛欢迎,尤其在学术研究和工业应用中表现出色。它的动态计算图特性使得模型的调试和修改变得更加直观和方便,同时,PyTorch拥有一个活跃的开发者社区,提供了大量的资源和支持,极大地推动了深度学习的研究和应用。

3.2 模型训练

在训练过程中,首先需要使用YOLOv5对视频帧进行目标检测。YOLOv5是一种高效的目标检测算法,能够在给定的图像中快速识别出运动员和足球,并生成相应的边界框。训练YOLOv5模型时,需要准备好标注的数据集,并设置模型的超参数(如学习率、批量大小等)。在训练完成后,模型会输出检测结果,包括每个目标的类别、置信度以及边界框的坐标。这些检测结果将为后续的目标跟踪提供重要信息。

import torch

# 加载YOLOv5模型

model = torch.hub.load('ultralytics/yolov5', 'yolov5s') # 使用预训练的YOLOv5小型模型

# 加载视频帧并进行检测

results = model('path/to/video/frame.jpg') # 读取视频帧

results.save() # 保存检测结果检测结果传递给Deep SORT进行跟踪。Deep SORT结合了运动信息和外观特征,通过使用预训练的CNN来提取运动员和足球的特征,从而提高跟踪的准确性。在此步骤中,Deep SORT会根据YOLOv5输出的边界框和类别信息,初始化目标的跟踪状态,并在后续帧中持续更新目标的运动轨迹。

from deep_sort import DeepSort

# 初始化Deep SORT

deepsort = DeepSort()

# 假设results包含YOLOv5检测结果

for frame in video_frames:

detections = results.xyxy[0] # 获取YOLOv5检测结果

bbox_xywh = []

confs = []

# 提取边界框和置信度

for det in detections:

x1, y1, x2, y2, conf, cls = det

bbox_xywh.append([(x1 + x2) / 2, (y1 + y2) / 2, x2 - x1, y2 - y1]) # 计算中心点和宽高

confs.append(conf)

# 使用Deep SORT进行跟踪

outputs = deepsort.update(bbox_xywh, confs, frame)在每一帧图像中,Deep SORT将根据检测到的运动员和足球的特征及运动轨迹进行身份匹配。通过计算外观特征之间的相似度和运动模型,Deep SORT能够确保每个目标的身份在整个序列中的连续性。这一过程对于处理快速移动、遮挡以及外观变化等复杂情况至关重要。通过这种方式,Deep SORT能够提供稳定的跟踪结果,为后续的分析和应用打下基础。

# 在每一帧中进行身份匹配

for frame in video_frames:

# 假设outputs是Deep SORT的跟踪结果

for track in outputs:

track_id = track[0] # 获取目标ID

bbox = track[1:5] # 获取边界框

# 在帧中可视化跟踪结果

cv2.rectangle(frame, (int(bbox[0]), int(bbox[1])), (int(bbox[2]), int(bbox[3])), (0, 255, 0), 2)

cv2.putText(frame, f'ID: {track_id}', (int(bbox[0]), int(bbox[1]) - 5), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (255, 0, 0), 2)

# 显示或保存帧

cv2.imshow('Tracking', frame)

cv2.waitKey(1)海浪学长项目示例:

最后

我是海浪学长,创作不易,欢迎点赞、关注、收藏。

毕设帮助,疑难解答,欢迎打扰!

更多推荐

已为社区贡献157条内容

已为社区贡献157条内容

所有评论(0)