笔记小结:卷积神经网络之卷积核的实现

在上我们,我们给出了卷积核,一个很容易想到的问题是给定XY能否学习出卷积核,答案是肯定的。在10次迭代之后,误差已经降到足够低。现在我们来看看我们[可以发现,1表示由1到0的边缘,0表示有0到1 的边缘。中间四列为黑色(0),其余像素为白色(1)。可以看到,与之间我们设置的结果很接近。实在是行云流水般丝滑)

·

本文为李沐老师《动手学深度学习》笔记小结,用于个人复习并记录学习历程,适用于初学者

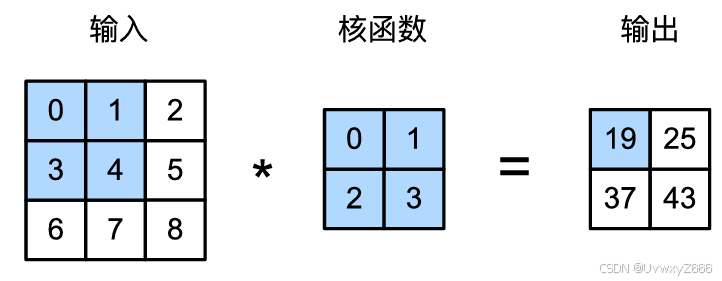

卷积核的实现

import torch

from torch import nn

def corr2d(X, K): #@save

"""计算二维卷积运算"""

h, w = K.shape #记录K的行数和列数

Y = torch.zeros((X.shape[0] - h + 1, X.shape[1] - w + 1))

for i in range(Y.shape[0]):

for j in range(Y.shape[1]):

Y[i, j] = (X[i:i + h, j:j + w] * K).sum()

return Y看个例子:

X = torch.tensor([[0.0, 1.0, 2.0], [3.0, 4.0, 5.0], [6.0, 7.0, 8.0]])

K = torch.tensor([[0.0, 1.0], [2.0, 3.0]])

corr2d(X, K)

#输出:

#tensor([[19., 25.],

# [37., 43.]])

卷积层的实现

class Conv2D(nn.Module):

def __init__(self, kernel_size):

super().__init__()

self.weight = nn.Parameter(torch.rand(kernel_size))

self.bias = nn.Parameter(torch.zeros(1))

def forward(self, x):

return corr2d(x, self.weight) + self.bias应用之简单的图像中目标边缘检测

首先,我们构造一个6×8像素的黑白图像。中间四列为黑色(0),其余像素为白色(1)。

X = torch.ones((6, 8))

X[:, 2:6] = 0

Xtensor([[1., 1., 0., 0., 0., 0., 1., 1.],

[1., 1., 0., 0., 0., 0., 1., 1.],

[1., 1., 0., 0., 0., 0., 1., 1.],

[1., 1., 0., 0., 0., 0., 1., 1.],

[1., 1., 0., 0., 0., 0., 1., 1.],

[1., 1., 0., 0., 0., 0., 1., 1.]])

构造一个简单的卷积核:

K = torch.tensor([[1.0, -1.0]])执行卷积运算:

Y = corr2d(X, K)

Y输出为:

tensor([[ 0., 1., 0., 0., 0., -1., 0.],

[ 0., 1., 0., 0., 0., -1., 0.],

[ 0., 1., 0., 0., 0., -1., 0.],

[ 0., 1., 0., 0., 0., -1., 0.],

[ 0., 1., 0., 0., 0., -1., 0.],

[ 0., 1., 0., 0., 0., -1., 0.]])

可以发现,1表示由1到0的边缘,0表示有0到1 的边缘。

学习卷积核

在上我们,我们给出了卷积核,一个很容易想到的问题是给定XY能否学习出卷积核,答案是肯定的。(训练那段“前向传播、误差计算、梯度清零、反向传播、更新参数”实在是行云流水般丝滑)

# 构造一个二维卷积层,它具有1个输出通道和形状为(1,2)的卷积核

conv2d = nn.Conv2d(1,1, kernel_size=(1, 2), bias=False)

# 这个二维卷积层使用四维输入和输出格式(批量大小、通道、高度、宽度),

# 其中批量大小和通道数都为1

X = X.reshape((1, 1, 6, 8))

Y = Y.reshape((1, 1, 6, 7))

lr = 3e-2 # 学习率

for i in range(10):

Y_hat = conv2d(X)

l = (Y_hat - Y) ** 2

conv2d.zero_grad()

l.sum().backward()

# 迭代卷积核

conv2d.weight.data[:] -= lr * conv2d.weight.grad

if (i + 1) % 2 == 0:

print(f'epoch {i+1}, loss {l.sum():.3f}')输出:

epoch 2, loss 11.296 epoch 4, loss 1.912 epoch 6, loss 0.328 epoch 8, loss 0.058 epoch 10, loss 0.011

在10次迭代之后,误差已经降到足够低。现在我们来看看我们[所学的卷积核的权重张量]。

conv2d.weight.data.reshape((1, 2))输出:

tensor([[ 0.9871, -0.9780]])

可以看到,与之间我们设置的结果很接近。

小结

- 二维卷积层的核心计算是二维互相关运算。最简单的形式是,对二维输入数据和卷积核执行互相关操作,然后添加一个偏置。

- 我们可以设计一个卷积核来检测图像的边缘。

- 我们可以从数据中学习卷积核的参数。

- 当需要检测输入特征中更广区域时,我们可以构建一个更深的卷积网络。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)