【深度学习】解锁AI密钥:神经网络算法详解及前沿探索

【深度学习】解锁AI密钥:神经网络算法详解及前沿探索

🍁 作者:知识浅谈,CSDN签约讲师,CSDN博客专家,华为云云享专家,阿里云专家博主

📌 擅长领域:全栈工程师、爬虫、ACM算法,大数据,深度学习

💒 公众号:知识浅谈

🔥 微信:zsqtcyl 联系我领取福利

🤞解锁AI密钥:神经网络算法详解及前沿探索🤞

🎈引言

神经网络,灵感来源于人类大脑的神经元系统,是深度学习的核心。自从人工智能领域的春天再次来临后,神经网络便开始在图像识别、语音识别、自然语言处理等领域展现出了其强大的能力。本文将从神经网络的基础理论出发,详细解析其算法,并探讨其前沿的进展。

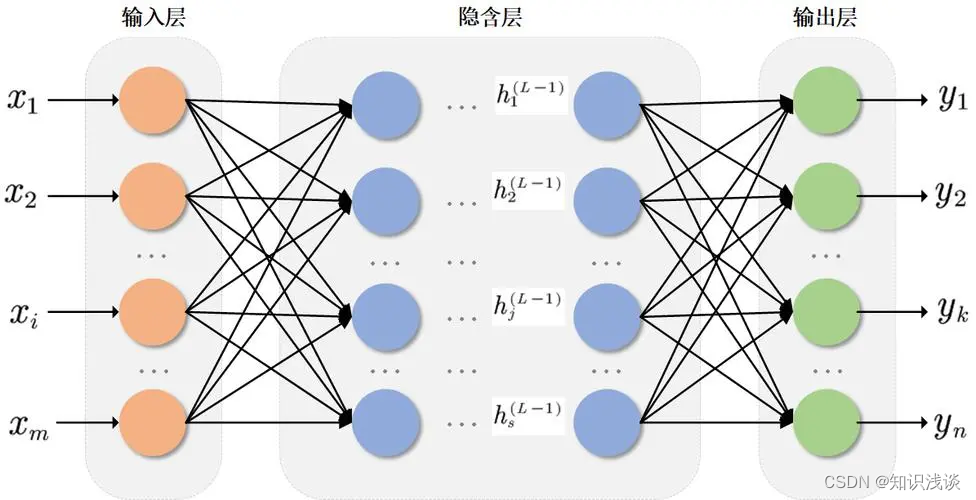

🎈神经网络的工作原理

简单来讲,神经网络模仿的是人类大脑中神经元的工作方式。一个基本的神经网络由输入层、多个隐藏层和输出层构成。每个层由多个节点(或称为“神经元”)组成,节点之间通过“突触”相连,突触上的权重代表了此连接的强度。

🍮示例代码:实现一个简单的神经网络

import numpy as np

def sigmoid(x):

return 1 / (1 + np.exp(-x))

def sigmoid_derivative(x):

return x * (1 - x)

# 输入数据集

input_data = np.array([[0,0,1],

[1,1,1],

[1,0,1],

[0,1,1]])

# 输出数据

output_data = np.array([[0],[1],[1],[0]]).T

# 随机种子,确保实验可复现

np.random.seed(1)

# 初始化权重

weights = 2 * np.random.random((3, 1)) - 1

for iteration in range(10000):

# 前向传播

input_layer = input_data

outputs = sigmoid(np.dot(input_layer, weights))

# 反向传播

error = output_data - outputs

adjustments = error * sigmoid_derivative(outputs)

# 更新权重

weights += np.dot(input_layer.T, adjustments)

print("输出结果:")

print(outputs)

这段代码建立了一个最简单形式的神经网络,只包含输入层和输出层,通过sigmoid函数作为激活函数来更新权重,实现了基本的学习过程。

🎈前沿探索

随着算法和计算能力的发展,神经网络的研究不断深入,出现了许多新的架构和应用。

-

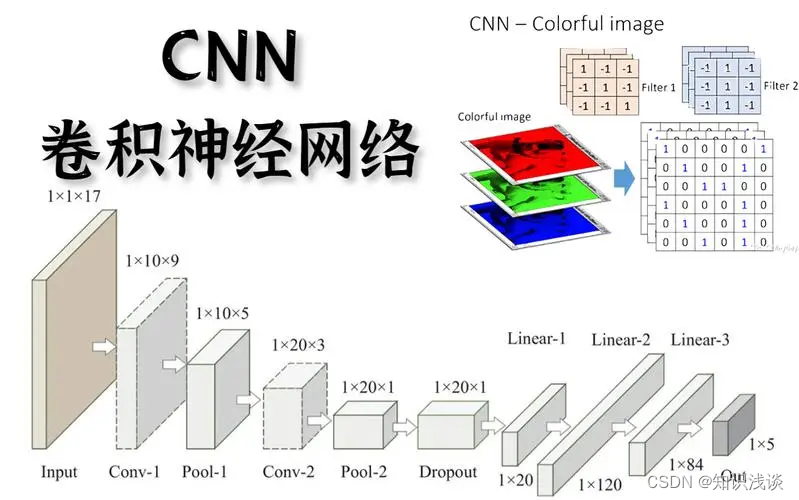

卷积神经网络(CNN)

在图像处理领域,CNN通过模拟人类视觉系统的机制,特别是其能够自动和有效地提取图像的特征,使其在图像分类和图像识别中获得了巨大成功。

-

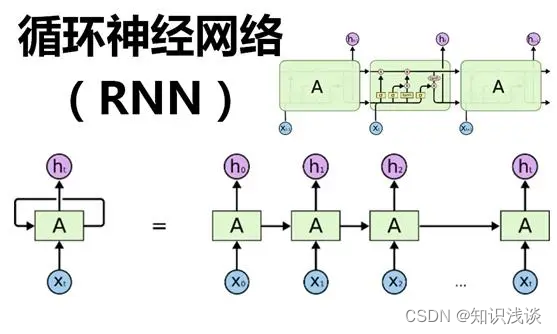

循环神经网络(RNN)

对于序列数据,如文本或时间序列数据,RNN显示出其独特的优势。它能够处理前后数据点之间的依赖关系,广泛应用于语言模型和时间序列预测等任务。

-

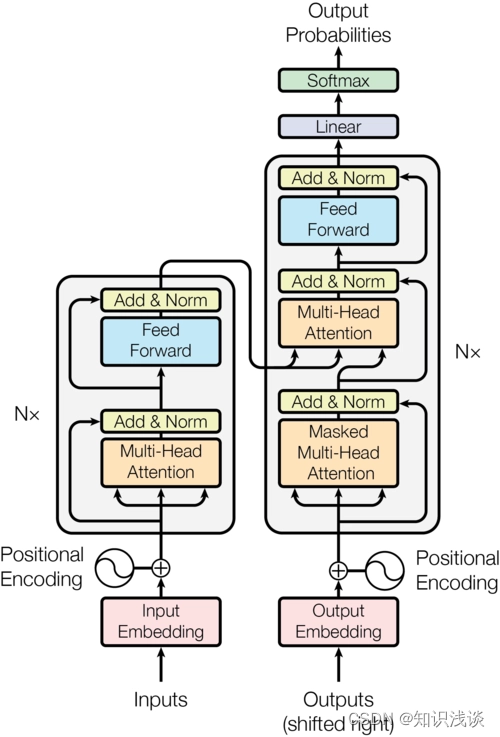

注意力机制和Transformer

注意力机制通过赋予模型能力以更加关注输入数据的特定部分,有效地提高了神经网络处理序列任务的能力。Transformer模型则是注意力机制的一种实现,它在处理长距离依赖问题上表现出色,特别是在自然语言处理领域。

-

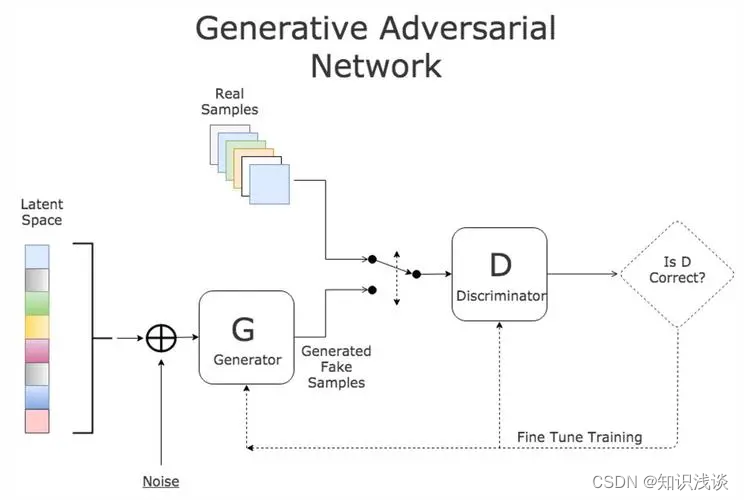

生成对抗网络(GAN)

GAN在图像生成、语音合成等领域展现出惊人的能力,通过让两个网络相互竞争,不断提高其生成的数据质量。

🎈结语

神经网络作为深度学习领域的核心技术,其发展速度之快,应用范围之广,已经远远超出了人们最初的想象。从基础的前馈神经网络到如今的GAN、Transformer,神经网络持续在人工智能领域掀起波澜。未来,随着研究的不断深入和计算资源的日益丰富,我们有理由相信,神经网络将会在人工智能的征途上越走越远,引领着我们进入一个全新的智能时代。

Writted By 知识浅谈

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)