TinyBERT 数据增强

关于tinyBERT论文的解读已经有很多文章了,本文仅仅说明数据增强的步骤。

·

TinyBERT 数据增强

TinyBERT: Distilling BERT for Natural Language Understanding

关于论文的解读已经有很多文章了,本文仅仅说明数据增强的步骤。

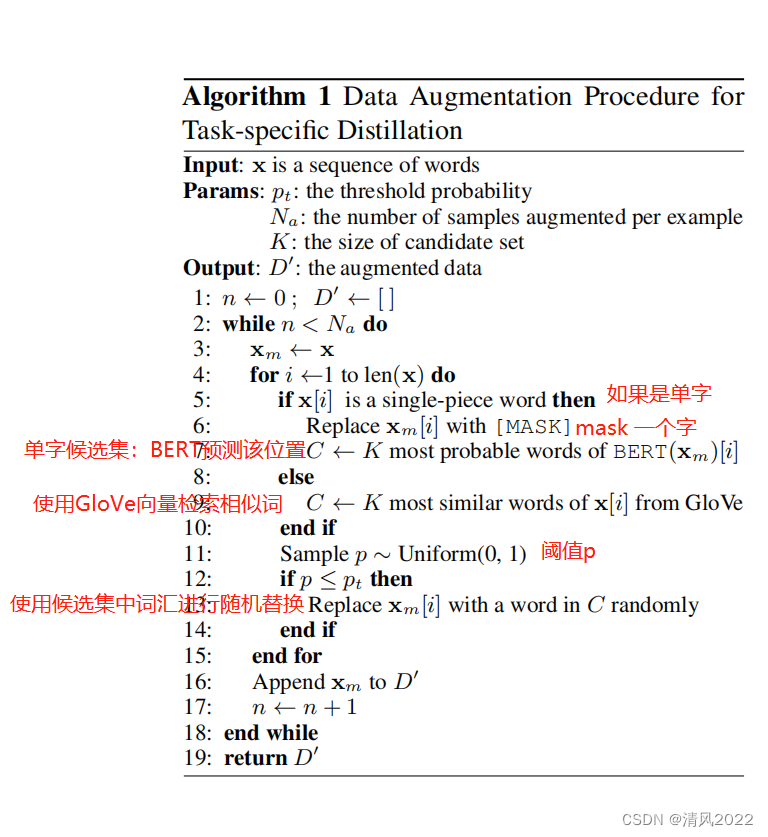

数据增强步骤

1.mask句子中的一个字词

1) 如果该单词的只有一个字

使用语言模型BERT预测出这个位置最有可能的m个词,作为候选集。

2)如果该单词含有多个字

使用GloVe的相似词向量的词汇进行组合,作为候选集。

2. 使用一个阈值p决定,是否将这个被mask的字词随机替换为候选集中的词汇。

3. 对文本中的每个词,重复地执行以上步骤,得到一个新的文本加入增强的数据集。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)