[深度学习] 多种损失函数 contrastive loss & triplet loss & L-softmax

参考:https://blog.csdn.net/zeroQiaoba/article/details/80086906损失函数对比损失函数(Contrastive loss function)三元组损失(triplet loss)triplet loss 和 contrastive loss 的缺陷两者都需要精细设计的 对的选择。由此引入Large_margin softmax(L-softma

·

参考:https://blog.csdn.net/zeroQiaoba/article/details/80086906

triplet_loss改进 :参考 https://blog.csdn.net/weixin_41803874/article/details/116202667

损失函数

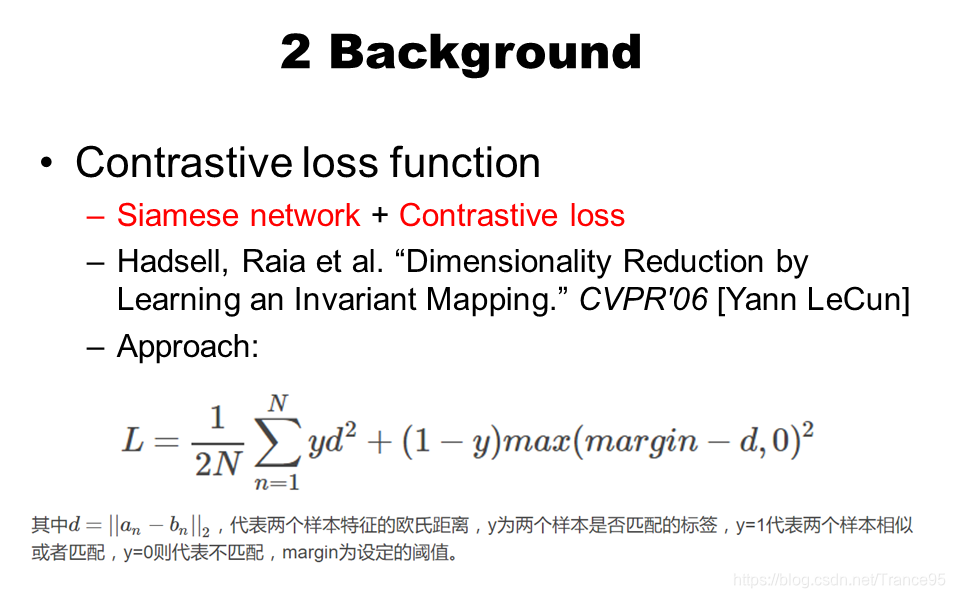

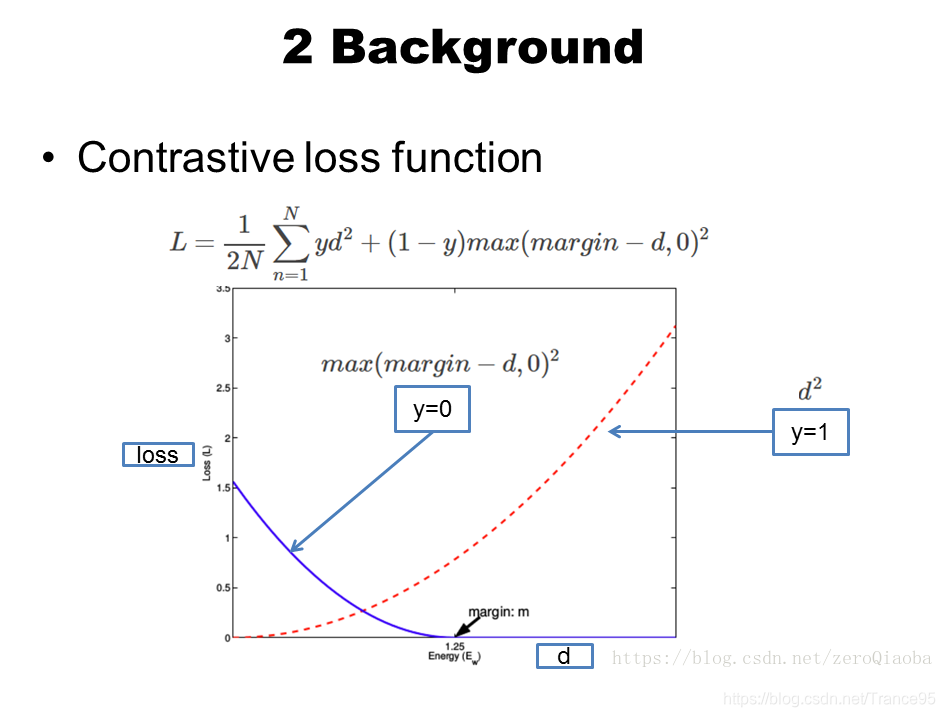

对比损失函数(Contrastive loss function)

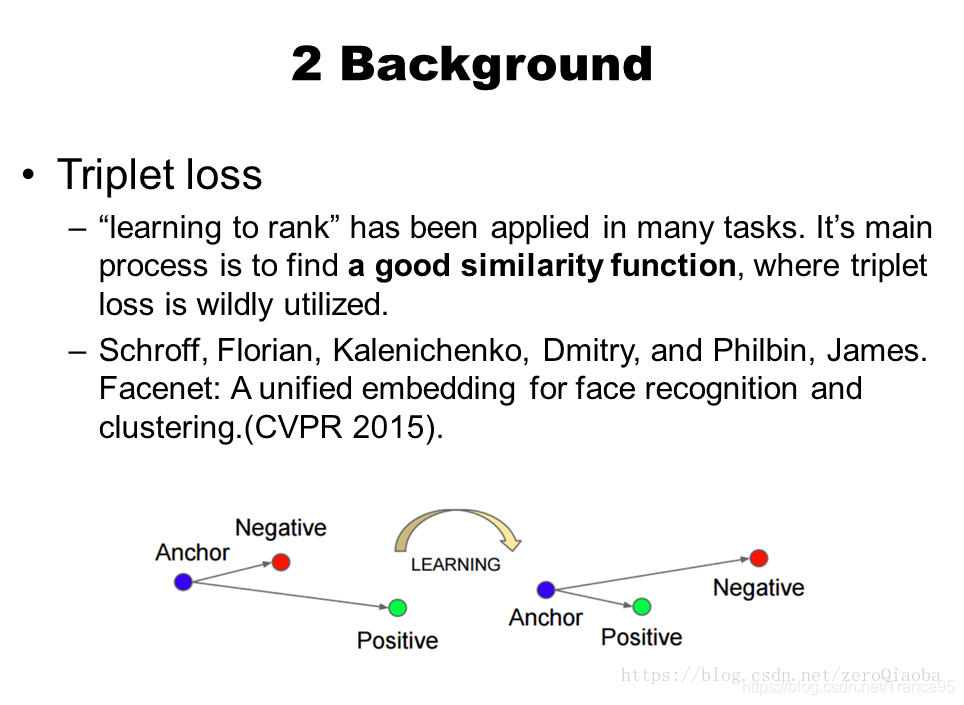

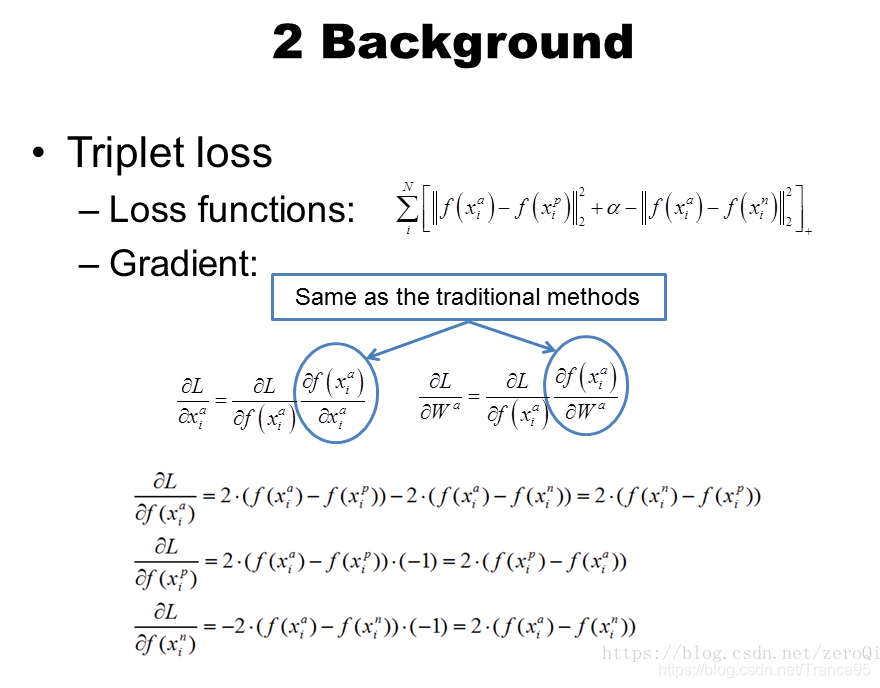

三元组损失(triplet loss)

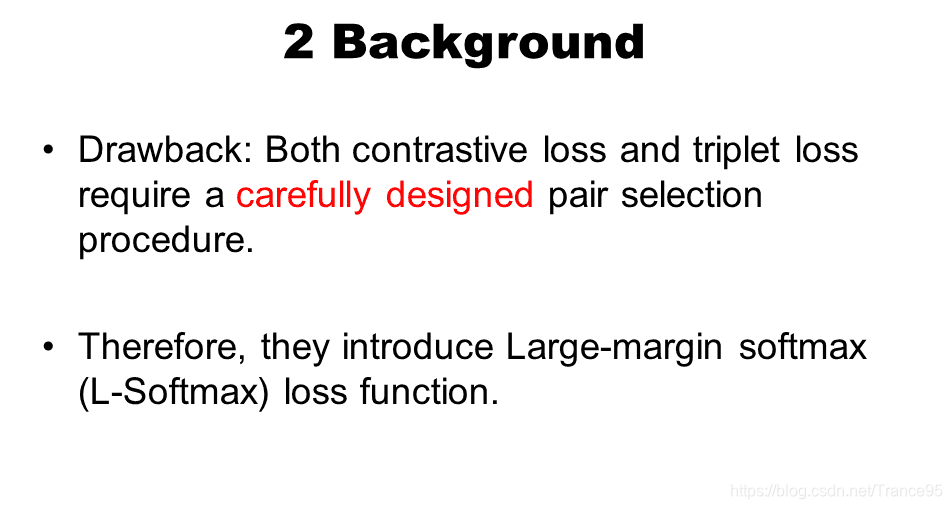

triplet loss 和 contrastive loss 三元组损失 和 对比损失 的缺陷

两者都需要精细设计的 对的选择。

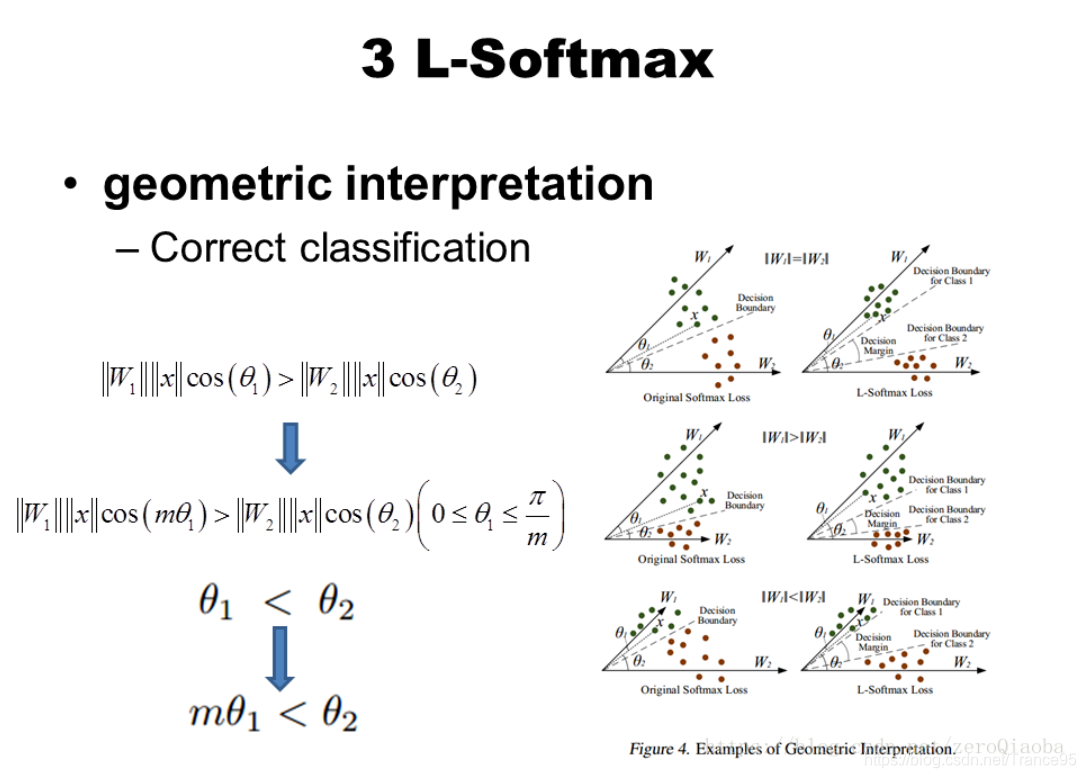

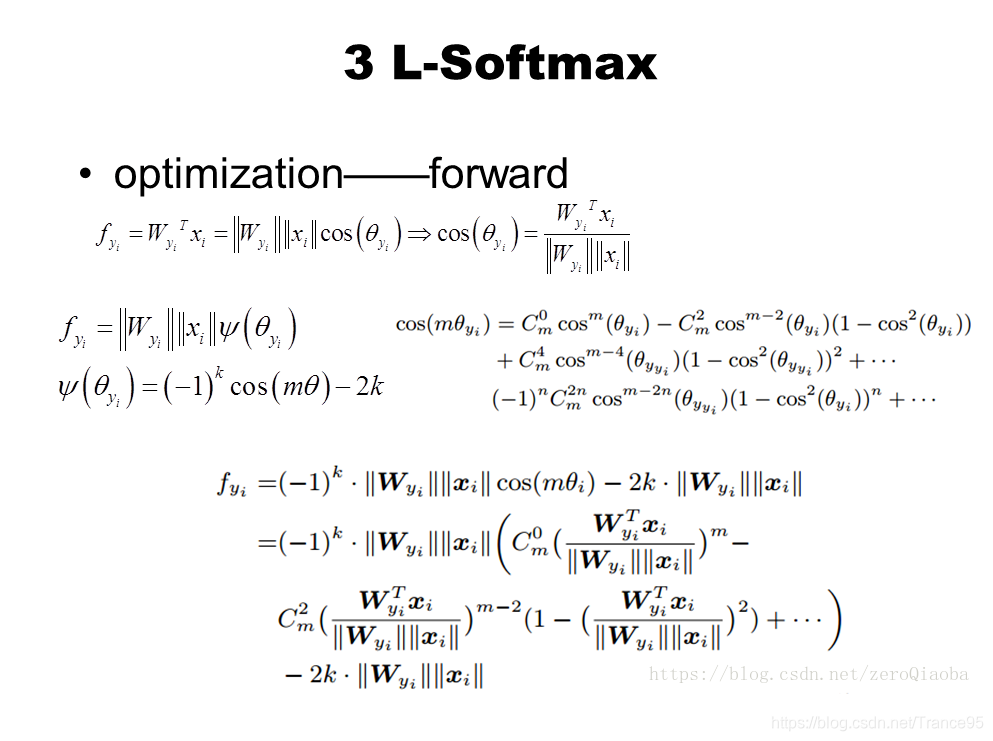

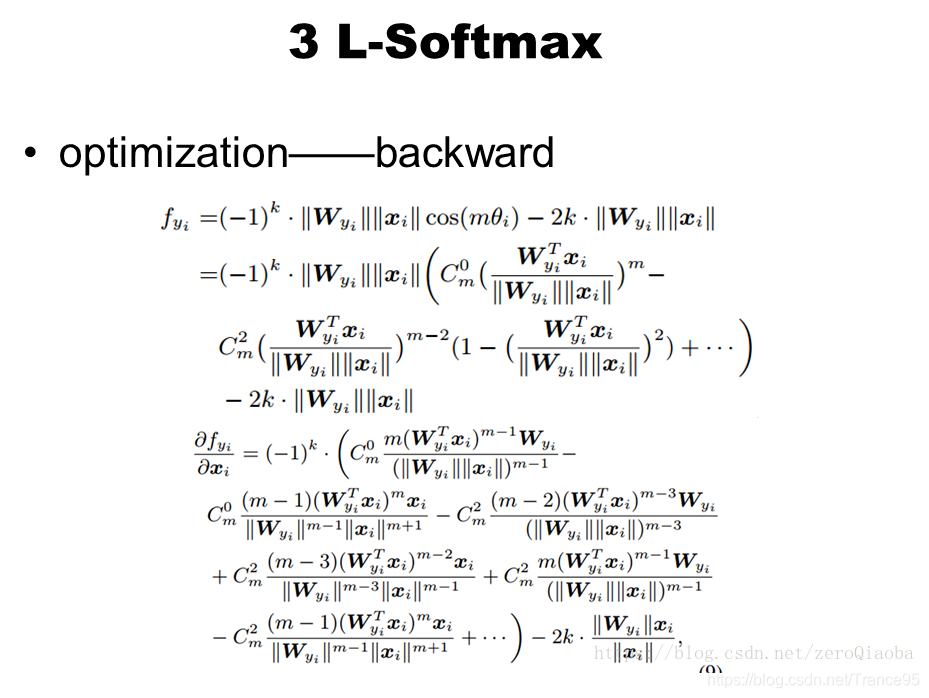

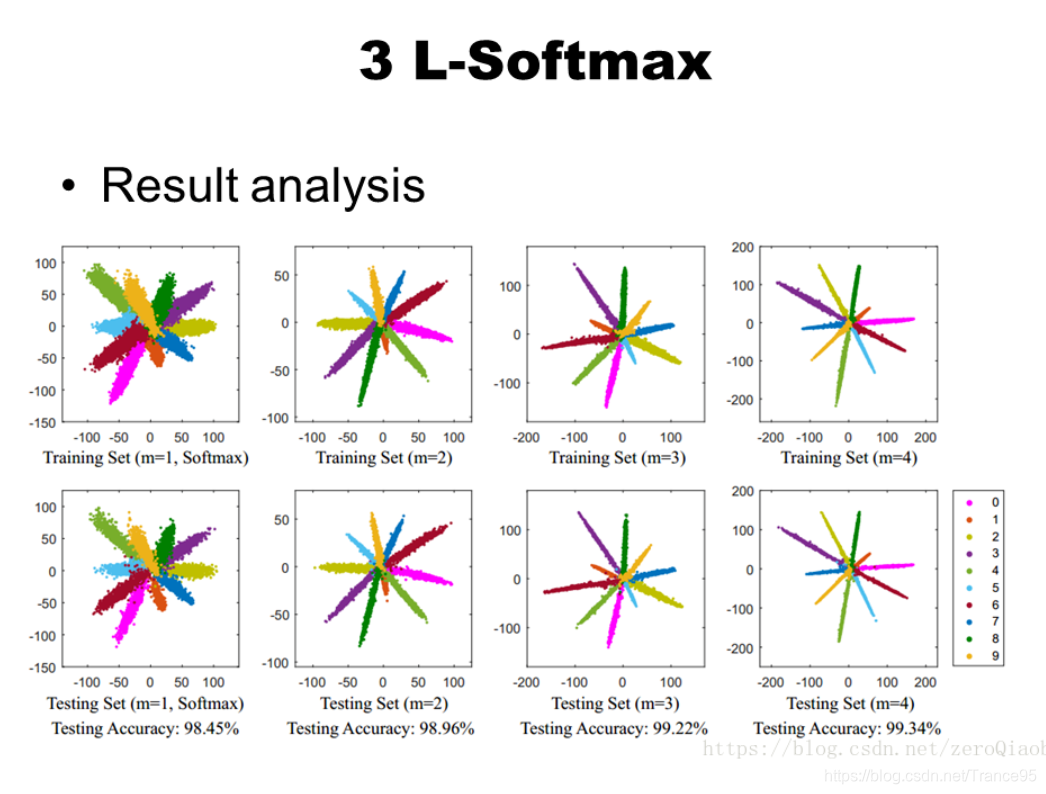

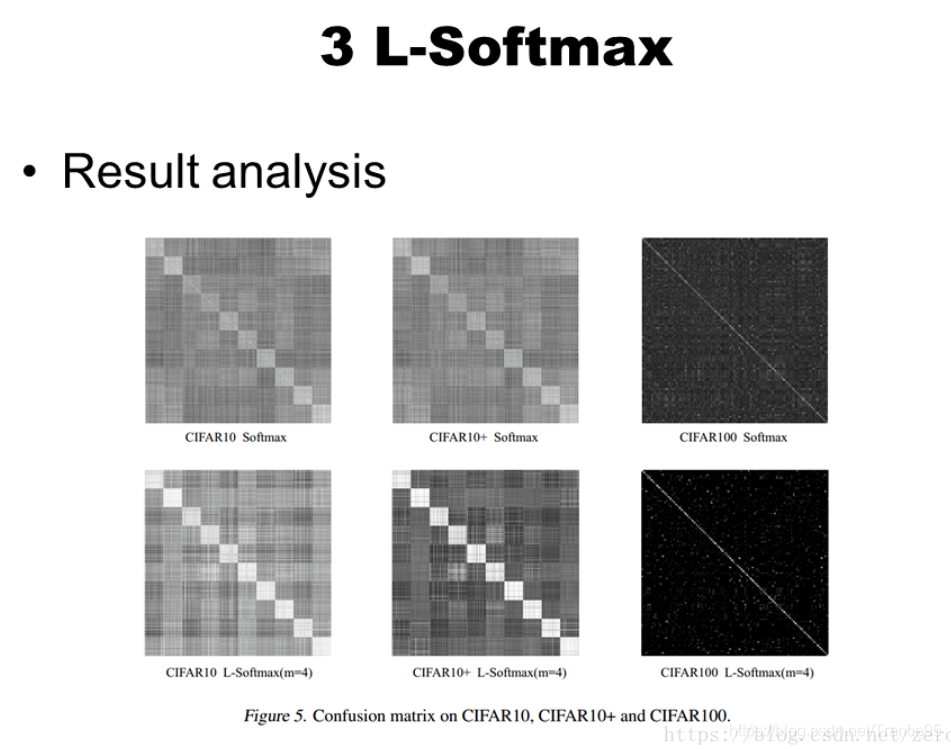

由此引入Large_margin softmax(L-softmax)。

L-Softmax(取log)

entropy loss

https://blog.csdn.net/Trance95/article/details/117876414

KL散度=交叉熵-熵

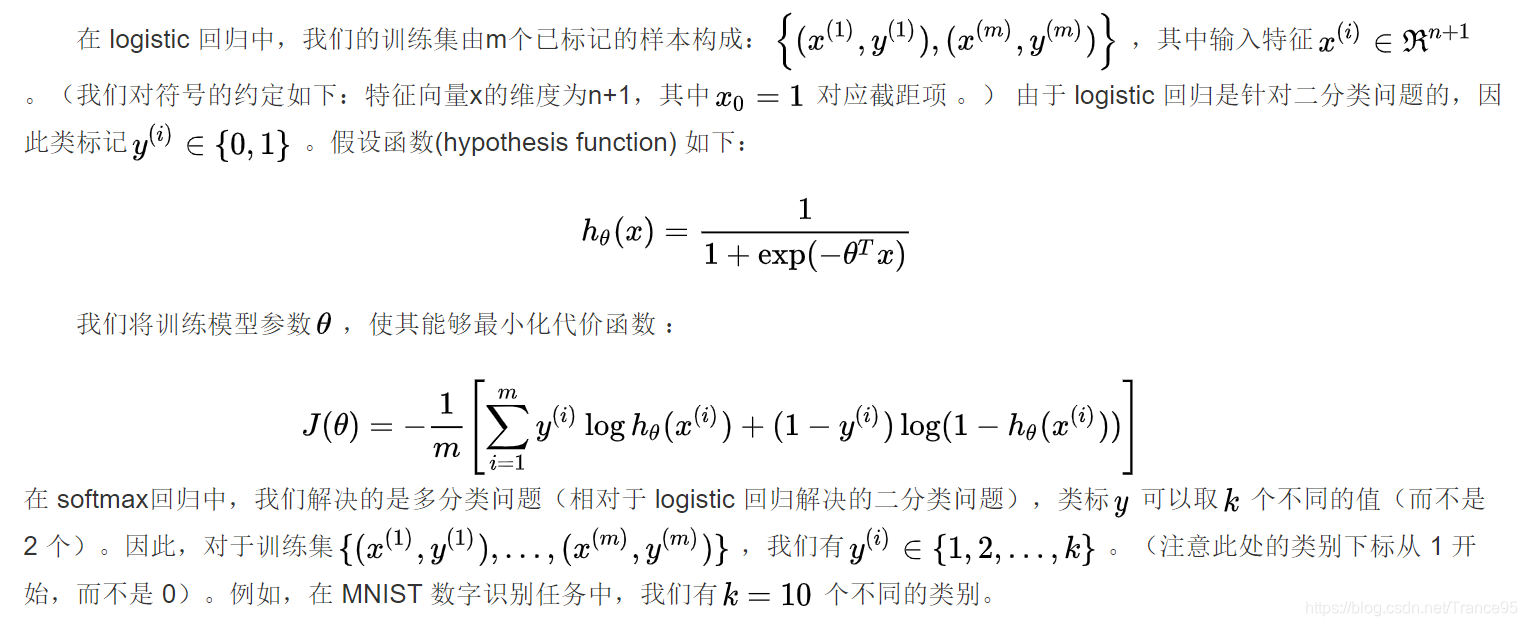

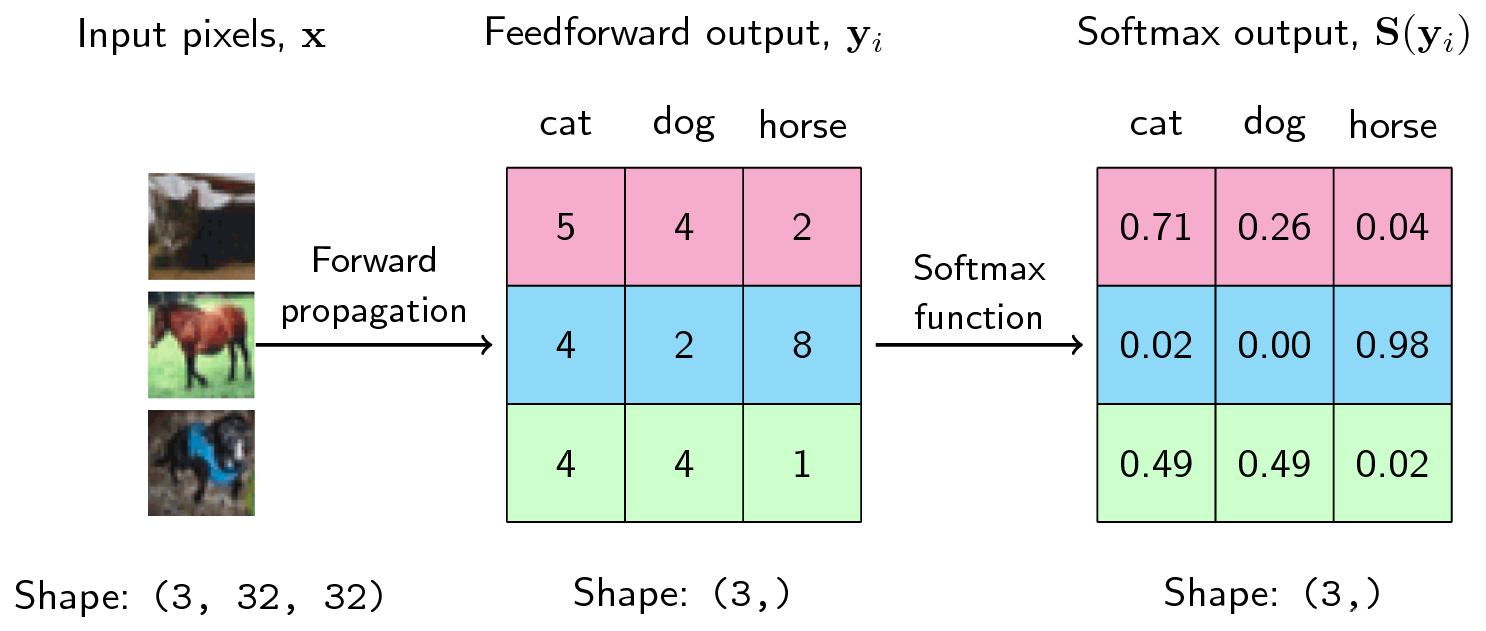

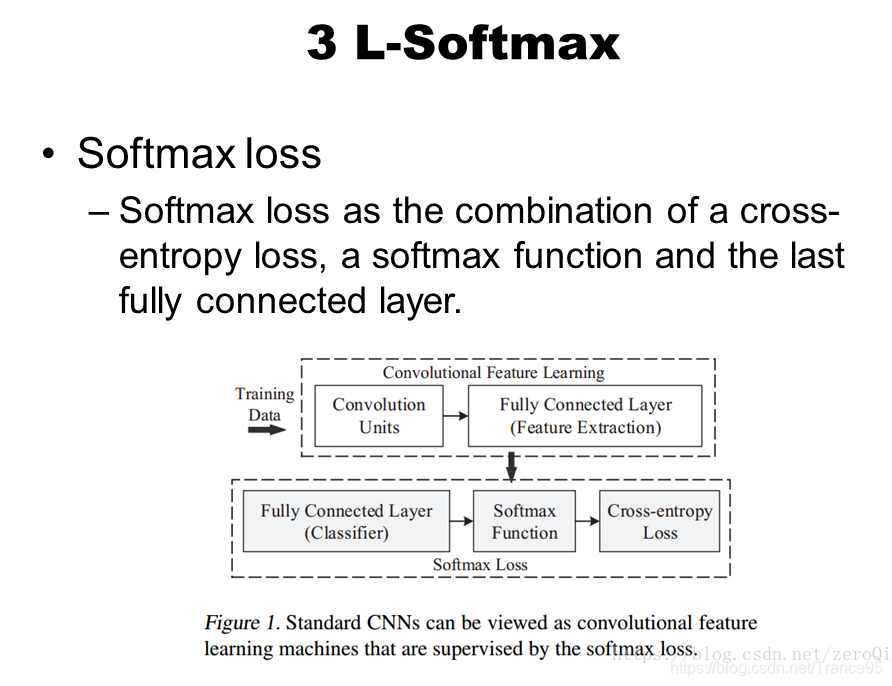

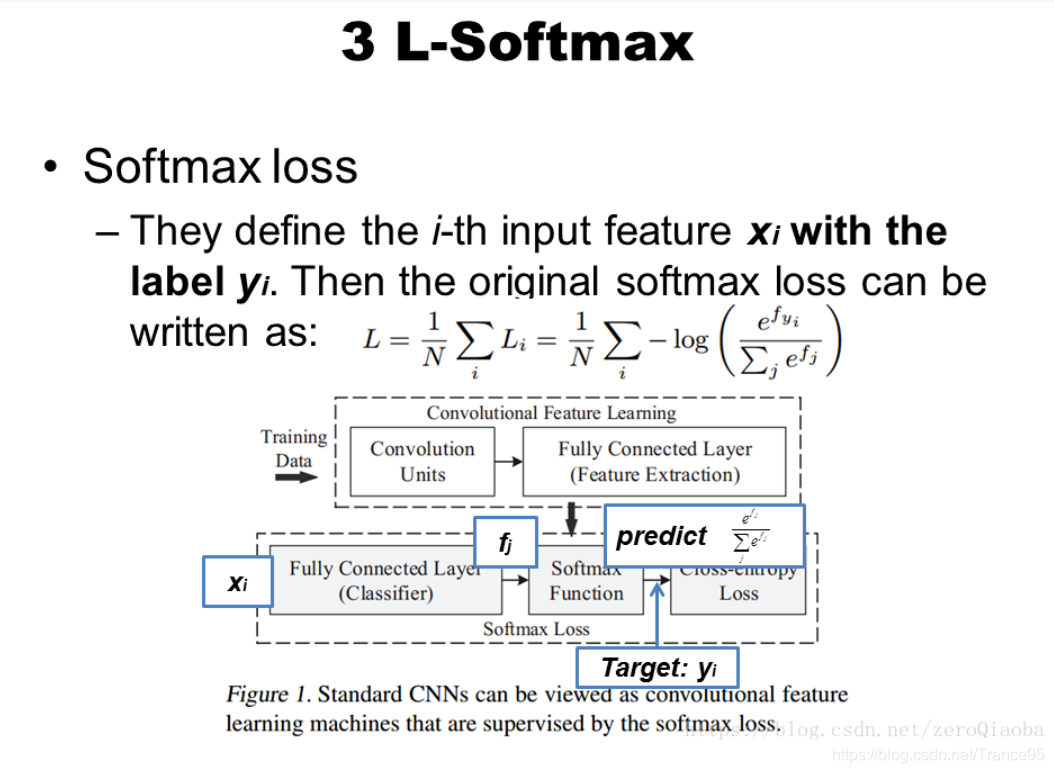

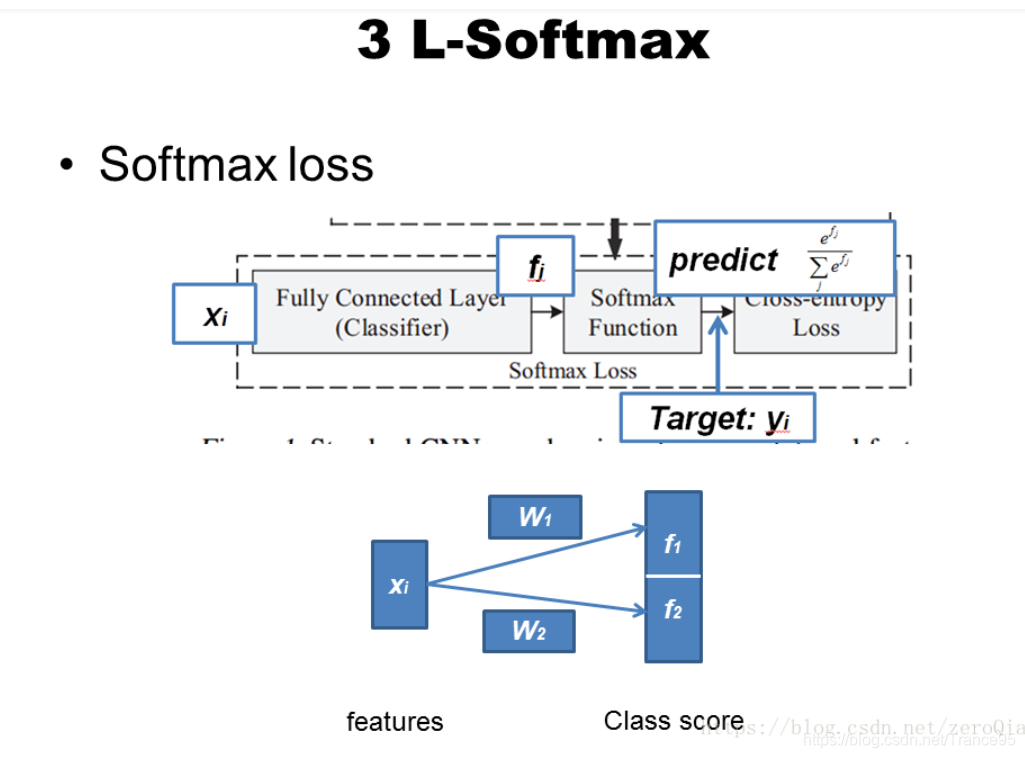

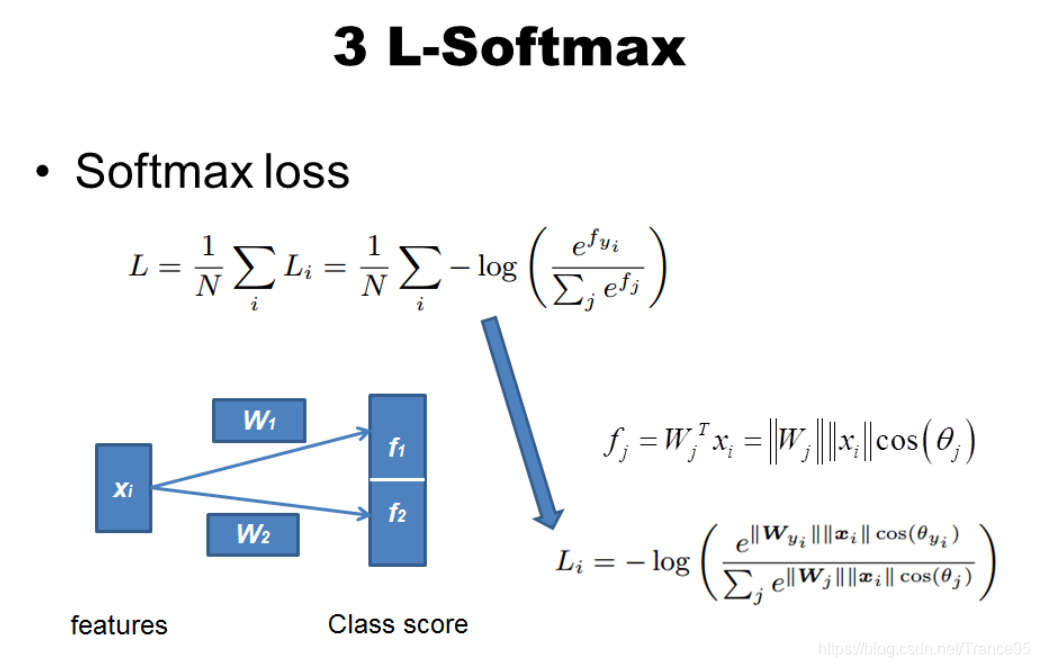

Softmax loss

交叉熵损失,softmax函数,全连接层 的结合。

https://baike.baidu.com/item/softmax%20%E9%80%BB%E8%BE%91%E5%9B%9E%E5%BD%92/22689563?fr=aladdin

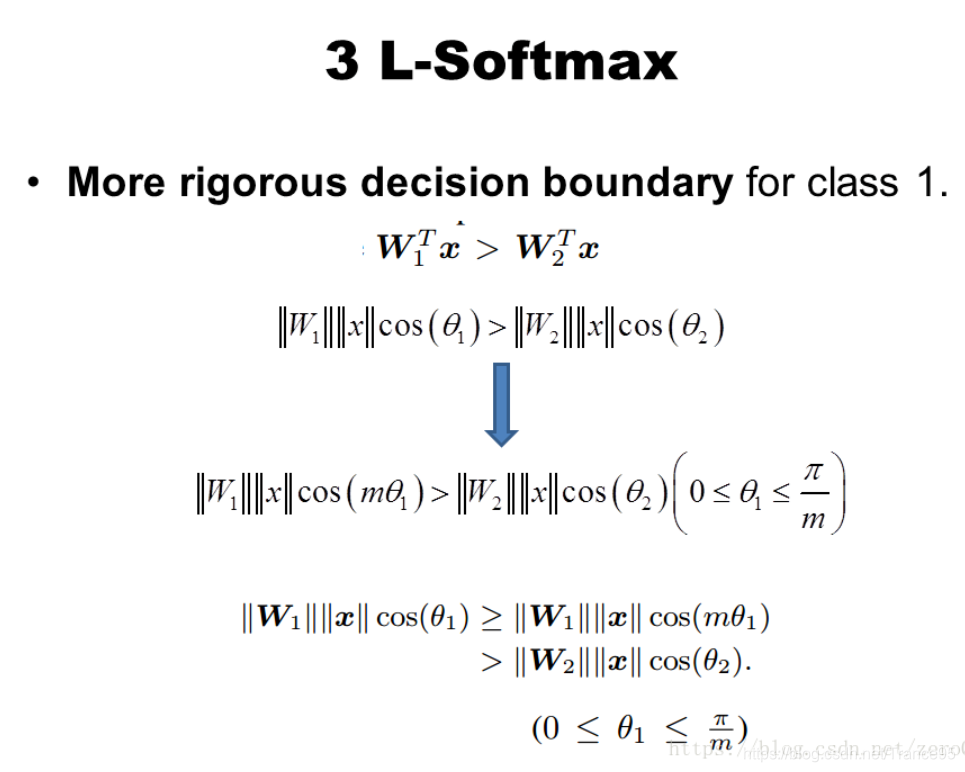

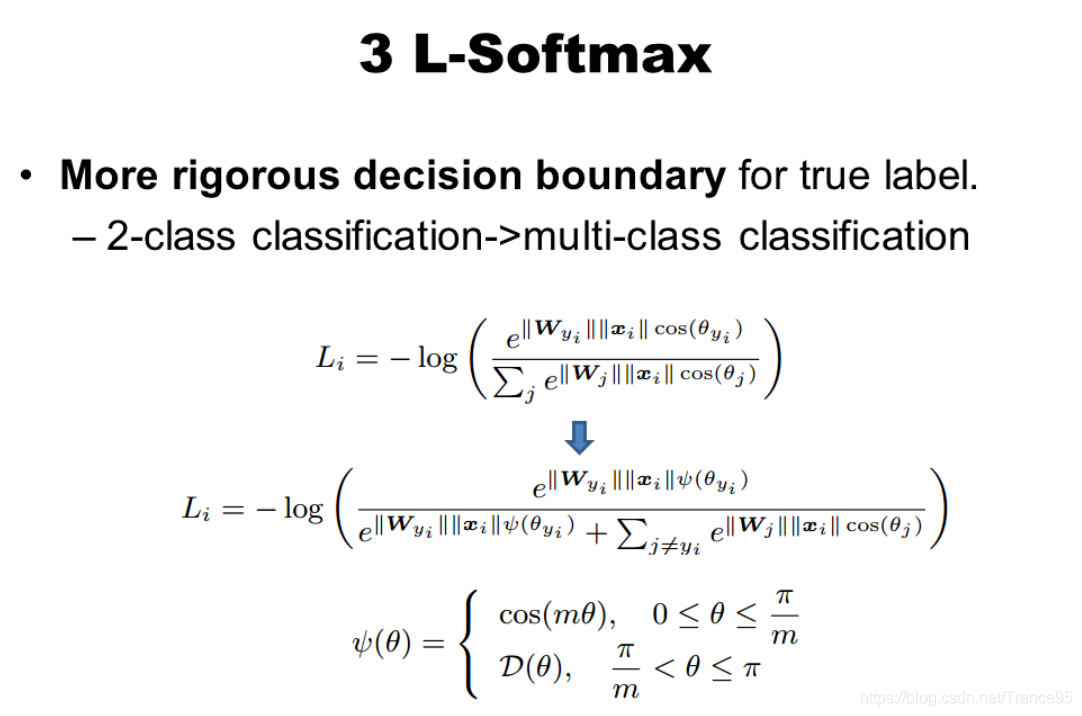

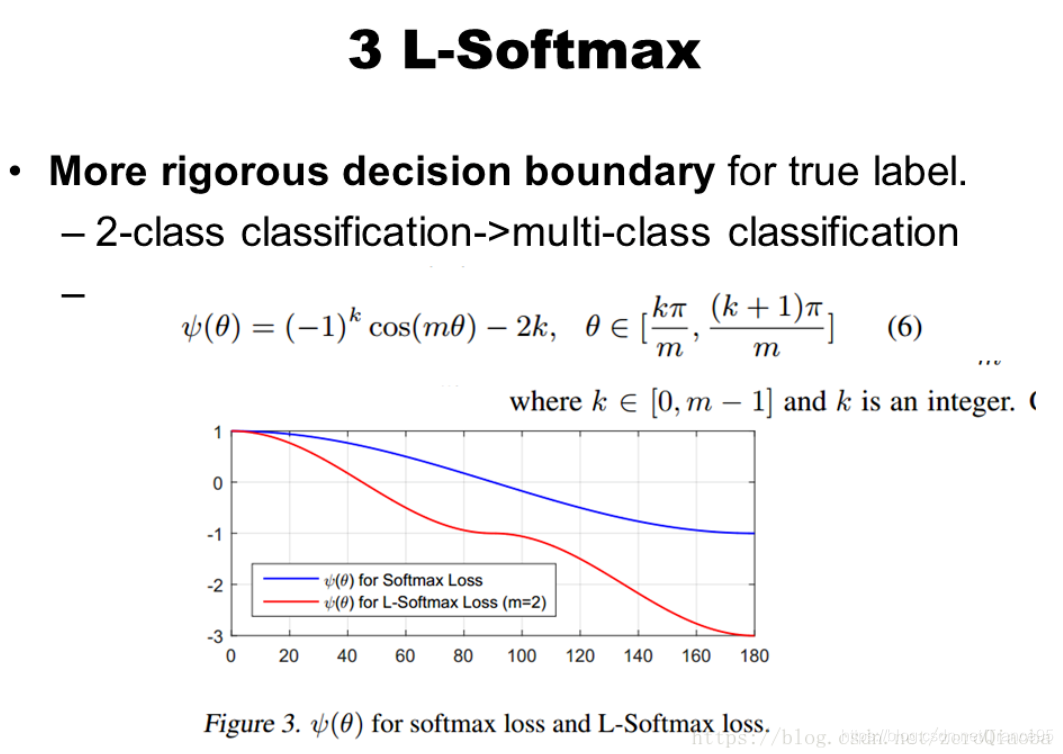

L-softmax 给出了更严格的决策边界。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)