Flink CDC 高频面试题_flinkcdc面试,2024年最新2024年大数据开发开发进阶课程

(1)在快照阶段,根据。

先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

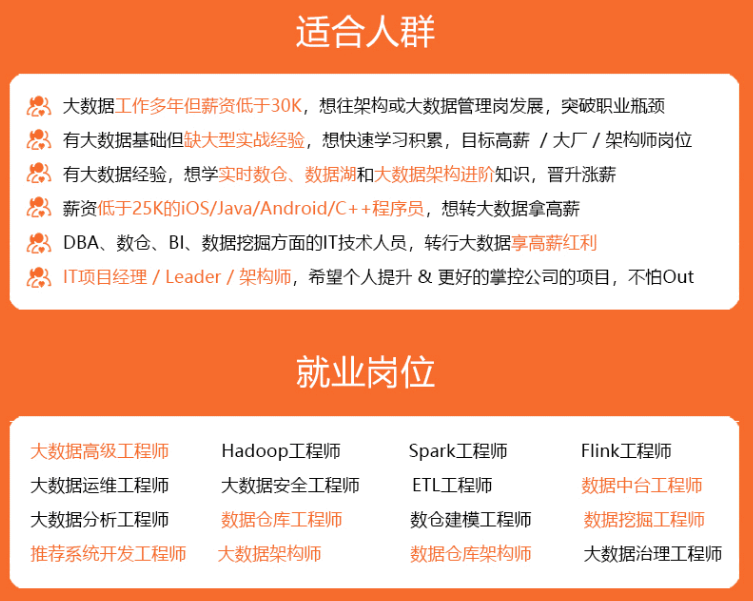

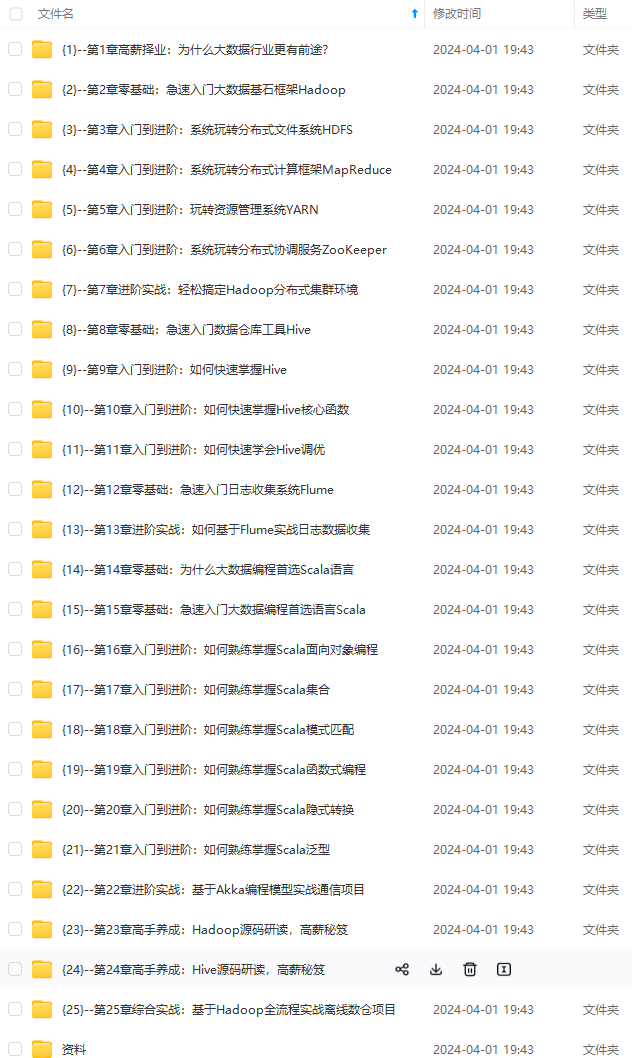

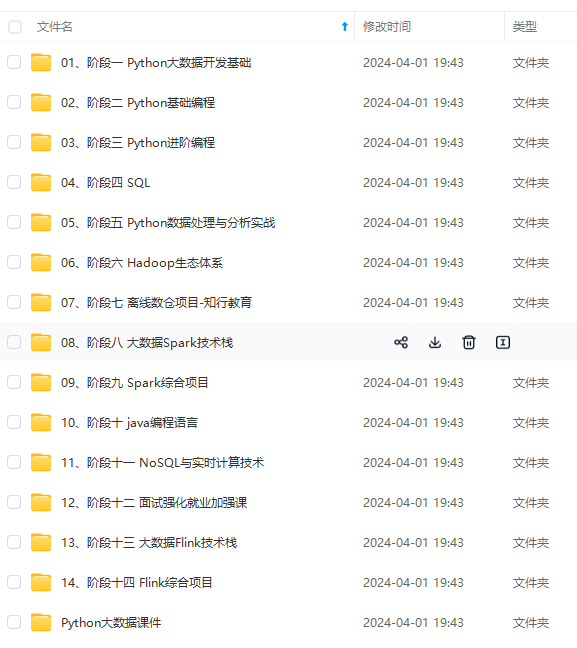

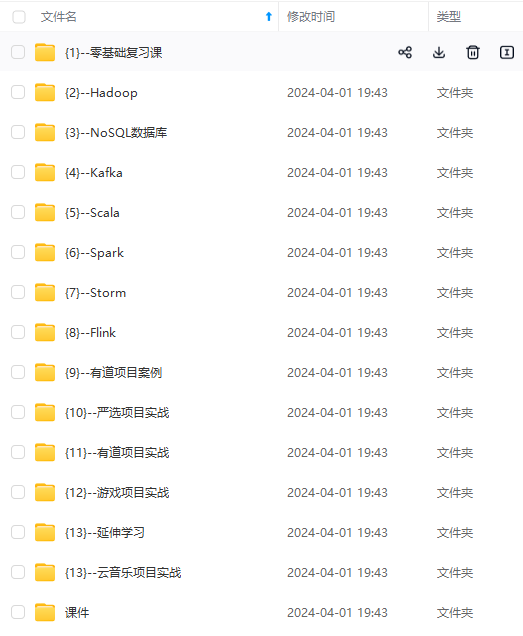

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

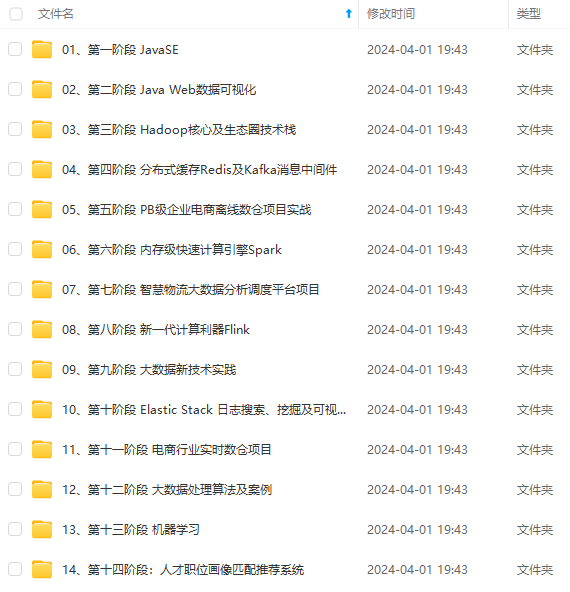

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

以全局锁为例,主要流程如下:

(1)首先是获取一个锁,然后再去开启可重复读的事务。

这里锁住操作是读取 binlog 的起始位置和当前表的 schema。

这样做的目的是保证 binlog 的起始位置和读取到的当前 schema 可以一一对应,因为表的 schema 是会改变的,比如删除列或者增加列。

在读取这两个信息后,SnapshotReader 会在可重复读事务里读取全量数据,在全量数据读取完成后,会启动 BinlogReader 从读取的 binlog 起始位置开始增量读取,从而保证全量数据 + 增量数据的无缝衔接。

3.2 flink cdc 1.x 问题点

当使用 Flush tables with read lock 语句时:

(1) 该命令会等待所有正在进行的 update 完成,同时阻止所有新来的 update。

(2) 该命令执行前必须等待所有正在运行的 select 完成,所有等待执行的 update 会等待更久。更坏的情况是,在等待正在运行 select 完成时,DB 实际上处于不可用状态,即使是新加入的 SELECT 也会被阻止,这是 Mysql Query Cache 机制。

(3) 该命令阻止其他事务 commit。

结论:加锁时间不确定,极端情况会锁住数据库。

3.3 DBlog Paper

针对 一致性加锁的痛点 Flink cdc 2.x 借鉴 Netflix 的 DBlog paper 设计了全程无锁算法

DBlog paper 论文的 chunk 切分算法

Chunk 切分算法其实和很多数据库的分库分表原理类似:通过表的主键对表中的数据进行分片。

假设每个 Chunk 的步长为 10,按照这个规则进行切分,只需要把这些 Chunk 的区间做成左开右闭或者左闭右开的区间,保证衔接后的区间能够等于表的主键区间即可。

因为每个 chunk 只负责自己主键范围内的数据,不难推导,只要能够保证每个 Chunk 读取的一致性,就能保证整张表读取的一致性,这便是无锁算法的基本原理。

在 Netflix 的 DBLog 论文中

Chunk 读取算法是通过在 DB 维护一张信号表,再通过信号表在 binlog 文件中打点,记录每个 chunk 读取前的 Low Position (低位点) 和读取结束之后 High Position (高位点) ,在低位点和高位点之间去查询该 Chunk 的全量数据。在读取出这一部分 Chunk 的数据之后,再将这 2 个位点之间的 binlog 增量数据合并到 chunk 所属的全量数据,从而得到高位点时刻,该 chunk 对应的全量数据。

3.4 flink cdc 2.x 无锁算法

Flink CDC 2.x 结合自身的情况,在 Chunk 读取算法上做了去信号表的改进,不需要额外维护信号表,通过直接读取 binlog 位点替代在 binlog 中做标记的功能,整体的 chunk 读算法描述如下图所示:

(1) 单个 Chunk 的一致性读:

比如正在读取 Chunk-1,Chunk 的区间是 [K1, K10],首先直接将该区间内的数据 select 出来并把它存在 buffer 中,在 select 之前记录 binlog 的一个位点 (低位点),select 完成后记录 binlog 的一个位点 (高位点)。然后开始增量部分,消费从低位点到高位点的 binlog。

- 图中的 - ( k2,100 ) + ( k2,108 ) 记录表示这条数据的值从 100 更新到 108;

- 第二条记录是删除 k3;

- 第三条记录是更新 k2 为 119;

- 第四条记录是 k5 的数据由原来的 77 变更为 100。

观察图片中右下角最终的输出,会发现在消费该 chunk 的 binlog 时,出现的 key 是 k2、k3、k5,我们前往 buffer 将这些 key 做标记。

对于 k1、k4、k6、k7 来说,在高位点读取完毕之后,这些记录没有变化过,所以这些数据是可以直接输出的;

对于改变过的数据,则需要将增量的数据合并到全量的数据中,只保留合并后的最终数据

例如,k2 最终的结果是 119 ,那么 只需要输出 +(k2,119),而不需要中间发生过改变的数据。

通过这种方式,Chunk 最终的输出就是在高位点 chunk 中最新的数据。

(2) 并发读取 Snapshot Chunk

基于 FLIP-27 实现,通过下图可以看到有 SourceEnumerator 的组件,这个组件主要用来划分 chunk,将划分好的 Chunk 提供给下游的快照读取器(SourceReader)去读取,通过把 chunk 分发给不同的 SourceReader 便实现了并发读取 Snapshot Chunk 的过程, 同时基于 FLIP-27 方便地做到 chunk 粒度的 checkpoint。

当 Snapshot Chunk 读取完成之后,需要有一个汇报的流程,如下图中橘色的汇报信息,将 Snapshot Chunk 完成信息汇报给 SourceEnumerator。

汇报的主要目的是为了后续分发 binlog chunk (如下图)。因为 Flink CDC 支持全量 + 增量同步,所以当所有 Snapshot Chunk 读取完成之后,还需要消费增量的 binlog,这是通过下发一个 binlog chunk 给任意一个 Source Reader 进行单并发读取实现的。

总结如下:

(1)在快照阶段,根据表的主键和表行的大小将 快照(Snapshot) 切割成多个 快照块(Snapshot Chunk) ,然后将 快照块 被分配给多个 快照读取器(SourceReader)。

(2)每个 快照读取器 使用 块读取算法(单个 Chunk 的一致性读) 读取其接收到的块,并将读取的数据发送到下游。源管理块的进程状态变更为(已完成或未完成),因此 快照阶段的源可以支持块级别的检查点。如果发生故障,可以恢复源并继续从最后完成的块中读取块。

(3)在所有快照块完成后,源将继续在单个任务(task)中读取 binlog。为了保证快照记录和 binlog 记录的全局数据顺序,binlog reader 会开始读取数据,直到 snapshot chunks 完成后有一个完整的 checkpoint,以确保所有的快照数据都被下游消费了。

(4)binlog reader 在 state 中跟踪消耗的 binlog 位置,因此 binlog phase 的 source 可以支持行级别的 checkpoint。

Flink 定期为源执行检查点,在故障转移的情况下,作业将从上次成功的检查点状态重新启动并恢复,并保证恰好一次语义。

4 CDC 高频面试题

1 flink Dynamic Table & ChangeLog Stream 了解吗?

Dynamic Table 是 Flink SQL 定义的动态表,动态表和流的概念是对等的参照上图,流可以转换成动态表,动态表也可以转换成流。

在 Flink SQL 中,数据从一个算子以 Changelog Stream 的形式流向另外一个算子时,任意时刻的 Changelog Stream 可以翻译为一个表,也可以翻译为一个流。

2 mysql 表与 binlog 的关系是什么?

MySQL 数据库的一张表所有的变更都记录在 binlog 日志中,如果一直对表进行更新,binlog 日志流也一直会追加,数据库中的表就相当于 binlog 日志流在某个时刻点物化的结果;日志流就是将表的变更数据持续捕获的结果。

这说明 Flink SQL 的 Dynamic Table 是可以非常自然地表示一张不断变化的 MySQL 数据库表。

3 flink cdc 底层的采集工具用哪个?

选择 Debezium 作为 Flink CDC 的底层采集工具,原因是 debezium 支持全量同步,也支持增量同步,同时也支持全量 + 增量的同步,非常灵活,同时基于日志的 CDC 技术使得提供 Exactly-Once 成为可能。

4 flink sql 与 debezium 的数据结构有哪些相似性?

通过对 Flink SQL 的内部数据结构 RowData 和 Debezium 的数据结构进行对比,可以发现两者非常相似。

(1)每条 RowData 都有一个元数据 RowKind,包括 4 种类型, 分别是插入 (INSERT)、更新前镜像 (UPDATE_BEFORE)、更新后镜像 (UPDATE_AFTER)、删除 (DELETE),这四种类型和数据库里面的 binlog 概念保持一致。

(2)Debezium 的数据结构,也有一个类似的元数据 op 字段, op 字段的取值也有四种,分别是 c、u、d、r,各自对应 create、update、delete、read。对于代表更新操作的 u,其数据部分同时包含了前镜像 (before) 和后镜像 (after)。

两者相似性很高,所以采用 debezium 作为底层采集工具

5 flink cdc 1.x 有哪些痛点?

(1) 一致性加锁的痛点

由于 flink cdc 底层选用 debezium 作为采集工具,在 flink cdc 1.x 全量 + 增量读取的版本设计中,Debezium 为保证数据一致性,通过对读取的数据库或者表进行加锁,但是 加锁 在数据库层面上是一个十分高危的操作。全局锁可能导致数据库锁住,表级锁会锁住表的读,DBA 一般不给锁权限。

(2)不支持水平扩展的痛点

因为 Flink CDC 底层是基于 Debezium,Debezium 架构是单节点,所以 Flink CDC 1.x 只支持单并发。

在全量读取阶段,如果表非常大 (亿级别),读取时间在小时甚至天级别,用户不能通过增加资源去提升作业速度。

(3)全量读取阶段不支持 checkpoint

Flink CDC 读取分为两个阶段,全量读取和增量读取,目前全量读取阶段是不支持 checkpoint 的;

因此会存在一个问题:当我们同步全量数据时,假设需要 5 个小时,当我们同步了 4 小时的时候作业失败,这时候就需要重新开始,再读取 5 个小时。

6 flink cdc 1.x 的加锁发生在哪个阶段?

加锁是发生在全量阶段。

Flink CDC 底层使用 Debezium 同步一张表时分为两个阶段:

- 全量阶段:查询当前表中所有记录;

- 增量阶段:从 binlog 消费变更数据。

大部分用户使用的场景都是全量 + 增量同步,加锁是发生在全量阶段,目的是为了确定全量阶段的初始位点,保证增量 + 全量实现一条不多,一条不少,从而保证数据一致性。

7 flink cdc 1.x 全局锁加锁的流程

从下图中我们可以分析全局锁和表锁的一些加锁流程,左边红色线条是锁的生命周期,右边是 MySQL 开启可重复读事务的生命周期。

以全局锁为例:

(1)首先是获取一个锁,然后再去开启可重复读的事务。

这里锁住操作是读取 binlog 的起始位置和当前表的 schema。

这样做的目的是保证 binlog 的起始位置和读取到的当前 schema 可以一一对应,因为表的 schema 是会改变的,比如删除列或者增加列。

在读取这两个信息后,SnapshotReader 会在可重复读事务里读取全量数据,在全量数据读取完成后,会启动 BinlogReader 从读取的 binlog 起始位置开始增量读取,从而保证全量数据 + 增量数据的无缝衔接。

表级锁有个特征:锁提前释放了可重复读的事务默认会提交,所以锁需要等到全量数据读完后才能释放。

8 全局锁会造成怎样的后果?

举例:当使用 Flush tables with read lock 语句时:

(1) 该命令会等待所有正在进行的 update 完成,同时阻止所有新来的 update。

(2) 该命令执行前必须等待所有正在运行的 select 完成,所有等待执行的 update 会等待更久。更坏的情况是,在等待正在运行 select 完成时,DB 实际上处于不可用状态,即使是新加入的 SELECT 也会被阻止,这是 Mysql Query Cache 机制。

(3) 该命令阻止其他事务 commit。

结论:加锁时间不确定,极端情况会锁住数据库。

9 Netflix 的 DBLog paper 核心设计描述一下?

在 Netflix 的 DBLog 论文中

Chunk 读取算法是通过在 DB 维护一张信号表,再通过信号表在 binlog 文件中打点,记录每个 chunk 读取前的 Low Position (低位点) 和读取结束之后 High Position (高位点) ,在低位点和高位点之间去查询该 Chunk 的全量数据。在读取出这一部分 Chunk 的数据之后,再将这 2 个位点之间的 binlog 增量数据合并到 chunk 所属的全量数据,从而得到高位点时刻,该 chunk 对应的全量数据。

10 flink cdc 2.x 如何设计的无锁算法?

Flink CDC 2.x 结合自身的情况,在 Chunk 读取算法上做了去信号表的改进,不需要额外维护信号表,通过直接读取 binlog 位点替代在 binlog 中做标记的功能,整体的 chunk 读算法描述如下图所示:

单个 Chunk 的一致性读:

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

示:

单个 Chunk 的一致性读:

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

[外链图片转存中…(img-qrHsZAEH-1713703484719)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)