深度学习 Deep Multi-Model Fusion for Single-Image Dehazing 阅读

Deep Multi-Model Fusion for Single-Image Dehazingabstract提出了一个深层的多模型融合网络可以集中集成多个模型来分离各层,提高单图像的去雾性能IntroductionAS model大气散射模型I(p)=J(p)×T(p)+A(p)×(1−T(p))I(p)=J(p)×T(p)+A(p)×(1−T(p))I(p)=J(p)×T(p)+A(p)×

深度学习 Deep Multi-Model Fusion for Single-Image Dehazing 阅读

概要

提出了一个深层的多模型融合网络

可以集中集成多个模型来分离各层,提高单图像的去雾性能

介绍

AS model

大气散射模型

I ( p ) = J ( p ) × T ( p ) + A ( p ) × ( 1 − T ( p ) ) I(p)=J(p)×T(p)+A(p)×(1−T(p)) I(p)=J(p)×T(p)+A(p)×(1−T(p))

p是像素的位置

I()是观察到的朦胧的图像

J()是要回恢复的基础场景辐射图像

可以理解为I()是有雾的,J()是恢复完没有雾的

T()代表的是透射图,它表示影响到达摄像头传感器的光份额的距离相关因素

A()是全球大气光,表示环境光强度

下面这篇文章给出了大气散射模型的推导

大气散射模型的推导过程

除雾

早期的除雾方法基于干净图像的统计数据,采用手工先验方法来估算T,然后带入到AS模型之中,但是会引入不良的伪影

而CNN的框架 从标记的数据集中学习传输图,显示出显着的改进,但是大多数现有的除雾网络还是基于之前提到的AS模型,倾向于对输入图像进行over-dehaze or under-dehaze

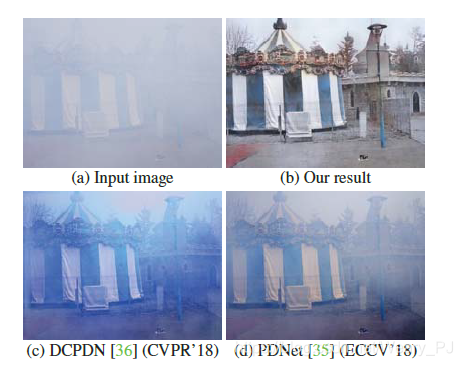

如下图的c到d所示

本篇文章将图像去雾分为 无雾层和有雾层

I = Φ ( J , H ) I=Φ(J,H) I=Φ(J,H)

Φ表示复杂雾化过程的层分离函数

本文的特点是

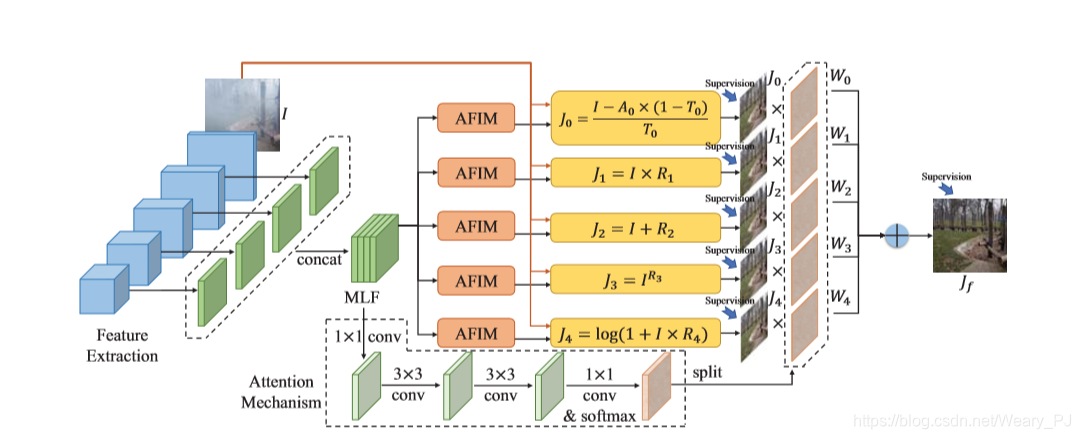

将上面两个模型集成(AC-model和雾化层分离模型),生成关注的多继承特征(AM-LIF)图,

开发了基于注意力机制的模块

上图是网络结构 融合了AS和分层分离模型

将最后的J0~J4加权输出,其中J0基于AS模型

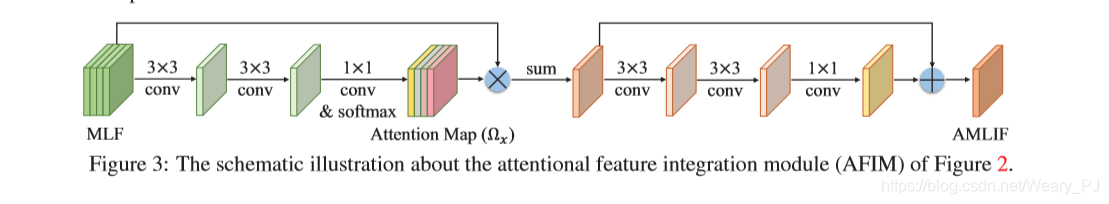

AFIM的结构如下

因为CNN中的浅层缺乏了输入模糊图像的信息,许多非雾细节会损坏

Ω x = S o f t m a x ( σ ( Θ ∗ M L F + b ) ) Ω_x=Softmax(σ(Θ∗MLF+b)) Ωx=Softmax(σ(Θ∗MLF+b))

Ω x Ω_x Ωx作为权重,以逐层方跟后面的MLF部分相乘,最后相加

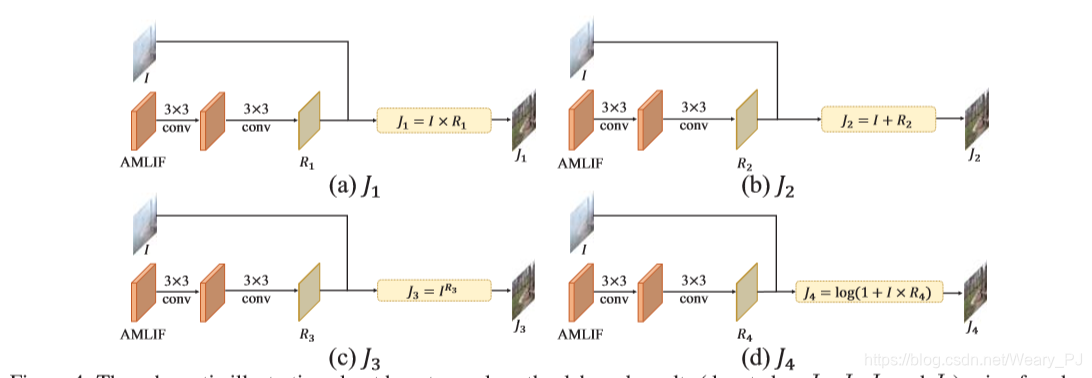

这是J1到J4的计算

大气散射模型预测

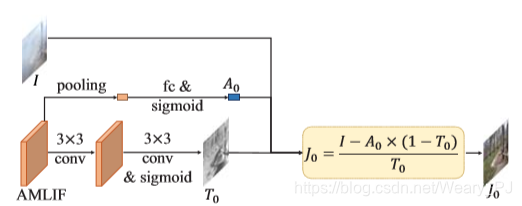

这是基于AS模型产生J0的过程

将AS模型嵌入到网络中,联合估计传输图、大气光和AMLIF的去湿化结果。上图显示了详细的体系结构。在AMLIF上使用两个3×3卷积层和一个sigmoid函数来计算传输图。然后,在AMLIF上使用一个全局平均池,然后使用两个完全连接的层和一个sigmoid函数来估计大气光。公式如上图所说

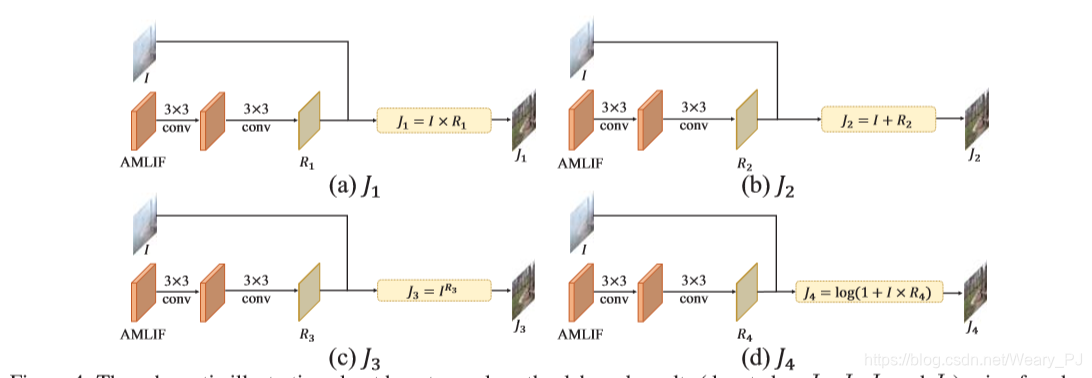

分层模型预测

探索了四个特定的层公式,并使用注意力机制将他们线性组合分别获得除雾结果

四种猜测:层乘法机制,加法运算,幂运算,以及对数运算

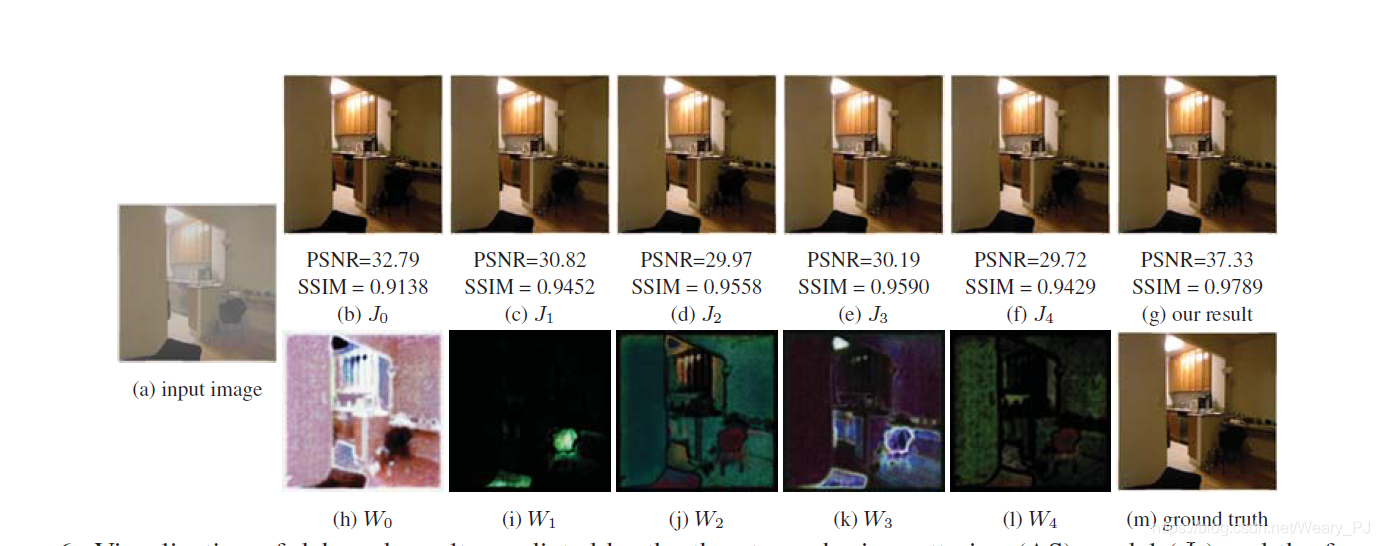

J0(AS)模型可以比其他模型更好的识别输入模糊图像,获得较高的PSNR和SSIM的指标的值,但AS模型会使得非雾背景图像更平滑,这些细节分别保留在分层模型的去雾结果中

五个除雾模式的结果存在互补信息,不同的权重可以突出不同的细节

后面将结果进行了检验与比较,证明了优越性

收获

将多个除雾模型融合,结合他们的优势,本文设计了一个新的深度多模式融合框架

本篇文章是接触的第一篇去雾类型的论文,所以也查找了一些资料

去雾算法(原理)

这篇文章让我了解了暗通道先验:每一幅图像的每一个像素的RGB三个颜色通道中,总有一个通道的灰度值很低

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)