AI伦理审查:信贷风控模型的偏见检测框架

随着人工智能(AI)技术的不断发展,AI在各个行业中的应用越来越广泛,特别是在金融领域。信贷风控模型作为金融科技中的一项重要技术,广泛应用于贷款审批、信用评估、风险预测等环节。然而,随着AI算法的引入,模型的偏见问题也逐渐显现,给金融行业的决策过程带来了新的伦理挑战。因此,AI伦理审查在信贷风控模型中变得至关重要。本篇文章将重点探讨信贷风控模型中的偏见检测框架,以及如何通过有效的AI伦理审查来确保

随着人工智能(AI)技术的不断发展,AI在各个行业中的应用越来越广泛,特别是在金融领域。信贷风控模型作为金融科技中的一项重要技术,广泛应用于贷款审批、信用评估、风险预测等环节。然而,随着AI算法的引入,模型的偏见问题也逐渐显现,给金融行业的决策过程带来了新的伦理挑战。因此,AI伦理审查在信贷风控模型中变得至关重要。

本篇文章将重点探讨信贷风控模型中的偏见检测框架,以及如何通过有效的AI伦理审查来确保AI决策的公平性与透明性。??

AI在信贷风控中的应用及挑战

在传统的信贷评估中,银行和金融机构通常依赖人工判断和历史数据来做出贷款决策。然而,随着大数据和机器学习技术的发展,越来越多的金融机构开始采用AI技术来提升信贷风控的效率和准确性。AI能够从海量数据中提取出潜在的模式,为信贷评估提供更为精准的预测。

然而,AI系统的黑箱特性使得其决策过程不容易被理解和追踪。这种“黑箱效应”使得AI可能会根据一些不公平的历史数据做出决策,进而加剧社会不平等现象。例如,某些历史数据中可能包含了性别、种族等因素的偏见,而这些偏见在AI模型中可能被放大和延续。??

偏见检测框架的必要性

为了应对AI偏见的问题,偏见检测框架成为了一项必要的工具。偏见检测框架通过系统地检测AI模型在做出决策时是否受到某些不公平因素的影响,从而确保AI的决策不偏向特定群体。对于信贷风控模型而言,这尤其重要,因为不公平的贷款决策可能导致某些群体被排除在外,或承受不合理的高利率。??

偏见检测框架的核心目的是识别和消除数据中的不公平因素,确保模型的输出是公正和透明的。常见的偏见类型包括但不限于性别偏见、种族偏见、年龄偏见等。这些偏见不仅可能违反公平原则,还可能触犯相关的法律法规,导致信贷机构面临法律风险。

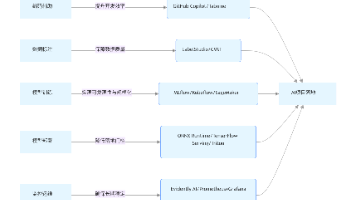

偏见检测框架的设计要素

一个有效的偏见检测框架通常包含以下几个关键要素:

-

- 数据审查与清洗:确保输入数据没有隐性偏见,尤其是在历史数据中,可能存在的性别、种族或地域偏见需要被清理和调整。

- 模型评估指标:设计有效的评估指标来衡量模型的公平性,例如公平性指标、对比公平性等。

- 透明性与可解释性:通过可解释性AI技术,使得模型的决策过程能够被清晰地理解和追踪,避免“黑箱”效应。

- 监控与反馈机制:在模型投入实际使用后,持续监控模型的表现,并根据反馈进行调整。

AI伦理审查的重要性

AI伦理审查不仅仅是对模型的偏见进行检测,它还包括对模型设计、数据选择和使用过程的全面审查。通过AI伦理审查,能够确保技术的应用符合社会和道德的标准,特别是在金融领域,这种审查尤为重要。??

AI伦理审查的核心原则包括:

-

- 公平性:确保所有用户在AI决策过程中受到公平对待。

- 透明性:决策过程必须能够被外部监督和解释,消除“黑箱”效应。

- 隐私保护:保证个人数据的隐私性和安全性,避免数据泄露和滥用。

- 责任追溯:确保在AI系统出现错误时,能够追溯到责任方,并采取相应措施。

这些原则有助于提升AI系统的社会信任,避免技术带来的负面影响。尤其是在信贷风控模型中,透明的AI决策过程可以增强用户对金融机构的信任,减少潜在的法律风险。

实践中的偏见检测与伦理审查案例

为了更好地理解偏见检测框架和AI伦理审查在信贷风控模型中的应用,以下是几个实际案例:

-

- 案例1:某银行使用AI模型评估贷款申请时,发现其模型对特定族裔的申请者存在较高的拒绝率。经过审查,发现模型在训练数据中存在历史上的族裔偏见。经过数据修正和重新训练后,拒绝率显著下降,决策更加公平。

- 案例2:另一家金融公司在使用AI模型时,发现模型对女性申请者的利率评估普遍偏高。经过深入分析,发现模型在性别识别上存在不公正的偏见。通过调整模型的公平性指标,问题得到了有效解决。

结论

随着AI技术的不断发展,信贷风控模型的偏见问题变得日益显著。为了确保AI决策的公平性和透明性,偏见检测框架和AI伦理审查至关重要。通过不断优化和完善AI模型,消除偏见,金融机构不仅能够提高决策的公正性,还能够提升用户的信任度和满意度。??

随着技术的不断进步,未来的信贷风控模型将能够更加精准地评估风险,同时更加公平地对待每一位贷款申请者。这不仅是技术发展的需求,更是社会责任的体现。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)